前言:

以下是最近将我开源的算法代码转发还标为原创的盗版博主及对应博文:

[1]

博主:Matlab科研工作室

← 引流到自己公众号下载

[2]

博主:紫极神光

← 让人付费下载

【!!!强调!!!】

本文算法对应的代码可在末尾的Github地址下载,完全开源,但仅供大家学术交流使用,并且算法已申请中文及国际专利,大家别被盗版博主赚了信息差的钱!

甚至有将我英文论文翻译作为中文论文原创的,这已经是严重的学术不端行为,一经发现,必严惩!!!!!!!!!!!!!!请各位保有基本的版权意识!未经我本人允许,严禁转载或转发到其它平台分享或牟利!

Questions&Answers:

Q1. 我的红外和可见光数据来源?

A1

.我论文里的以及Github公开所有变电设备可见光和红外图像均为课题组自建数据集(自己去变电站拍摄的),若使用本人的数据集,请注明或引用数据来源

Q2.我的源图像数据集做过后处理吗?

A2

.我的源图像没有做过后处理,但是我的配准算法里面对我的数据集有去畸变的处理,去畸变参数就是代码里,cp-readimage函数的第一个输入参数就是是否要对输入图像进行去畸变,当然了对于你自己需要去畸变的图像数据请自己修改cp-undistort函数里的参数。

Q3.如何输出并保存配准后的图像?

A3

. 代码中

[~,affmat] = cp_getAffine(I1gray,I2gray,P1,P2)

中I1gray是待配准图像的灰度图,I2gray是基准图像灰度图,P1是I1中的匹配点,P2是I2中的匹配点,

affmat

是一个包含由P1变换到P2(也就是I1变换到I2)的图像变换的结构体,其中

affmat.T

是透视变换矩阵,使用

Itransform = imwarp(I1, affmat, 'OutputView', imref2d(size(I2)))

可以得到以I2为参考图像的I1的变换后的图像,使用

imwrite(Itransform, '你的文件名')

保存图像。

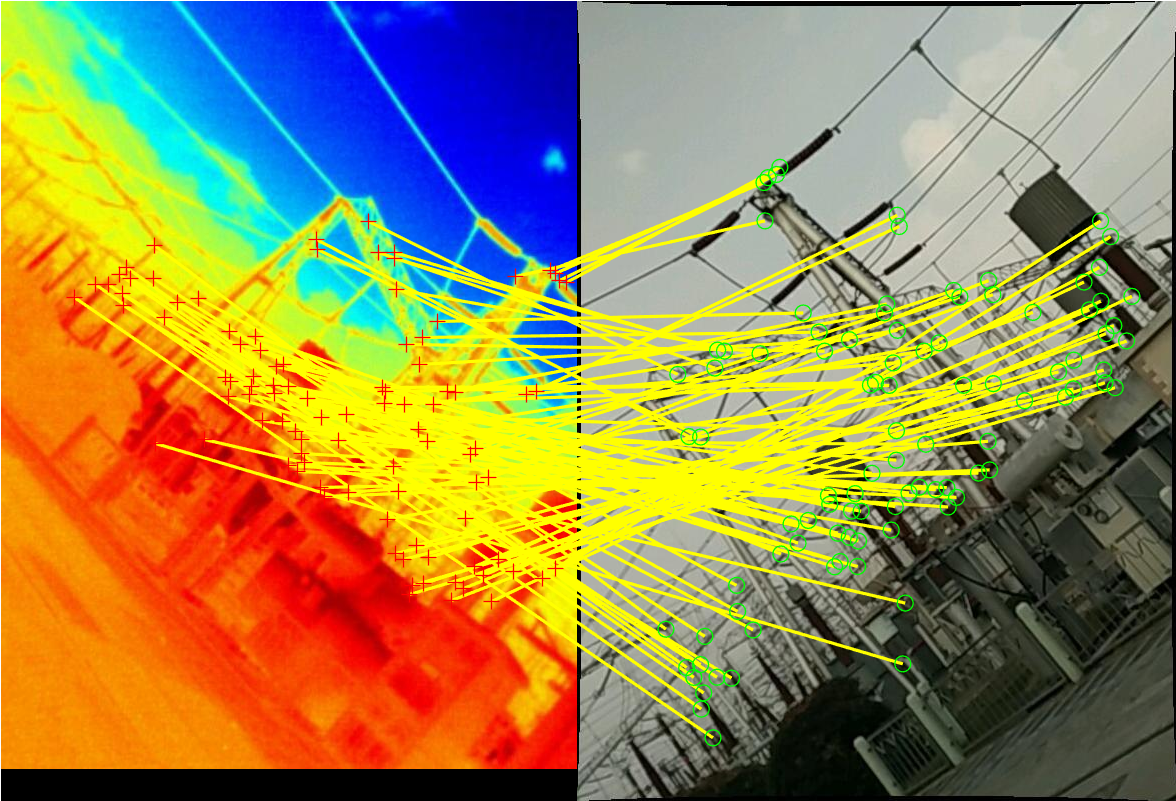

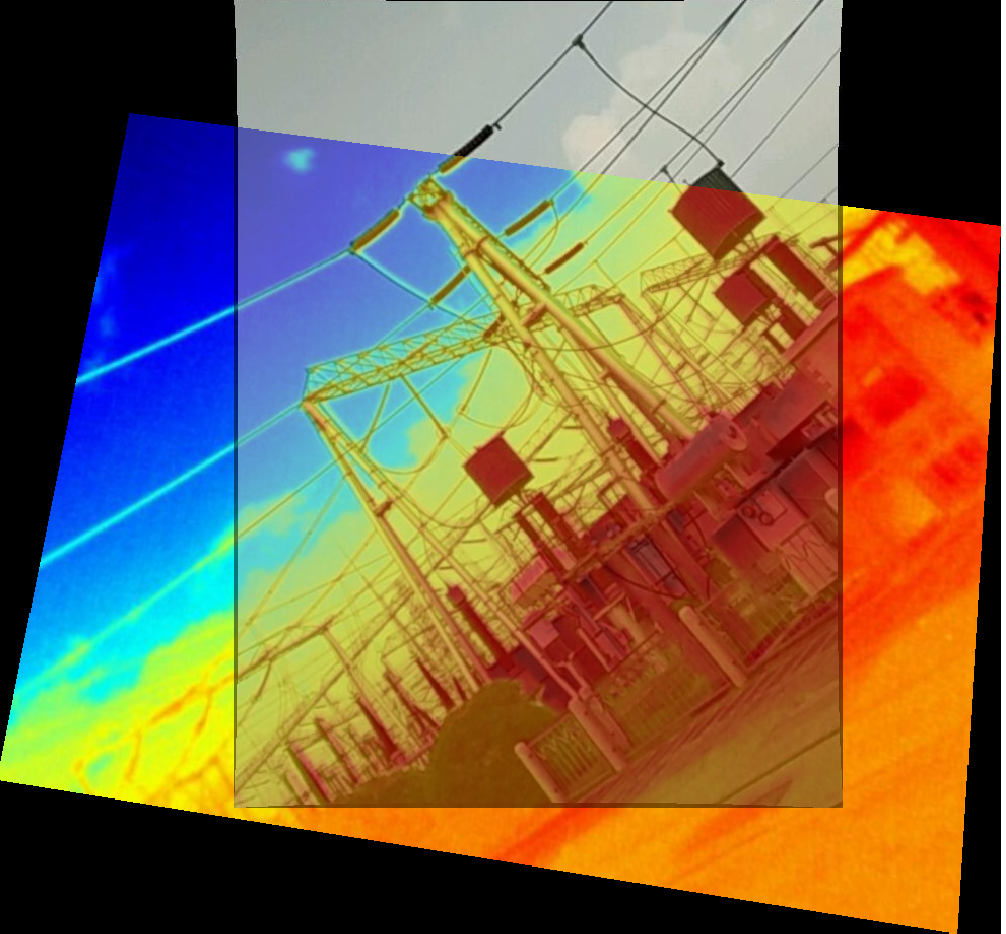

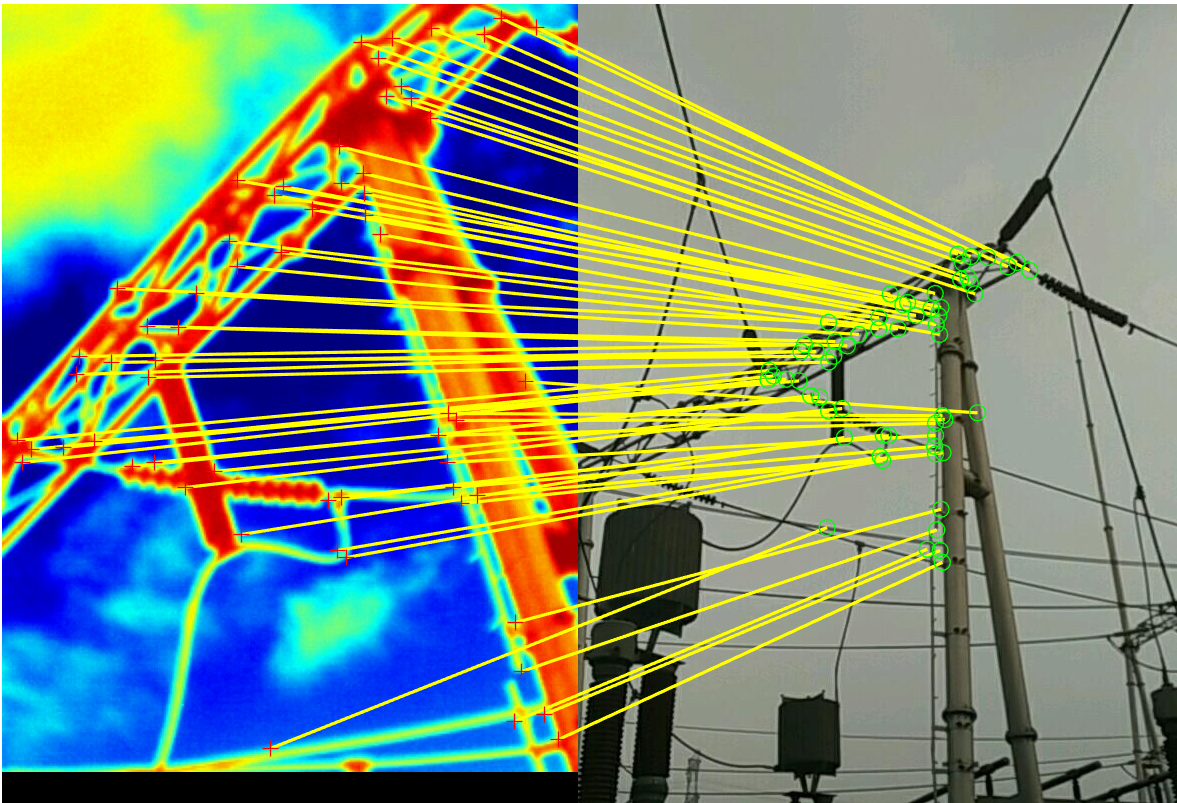

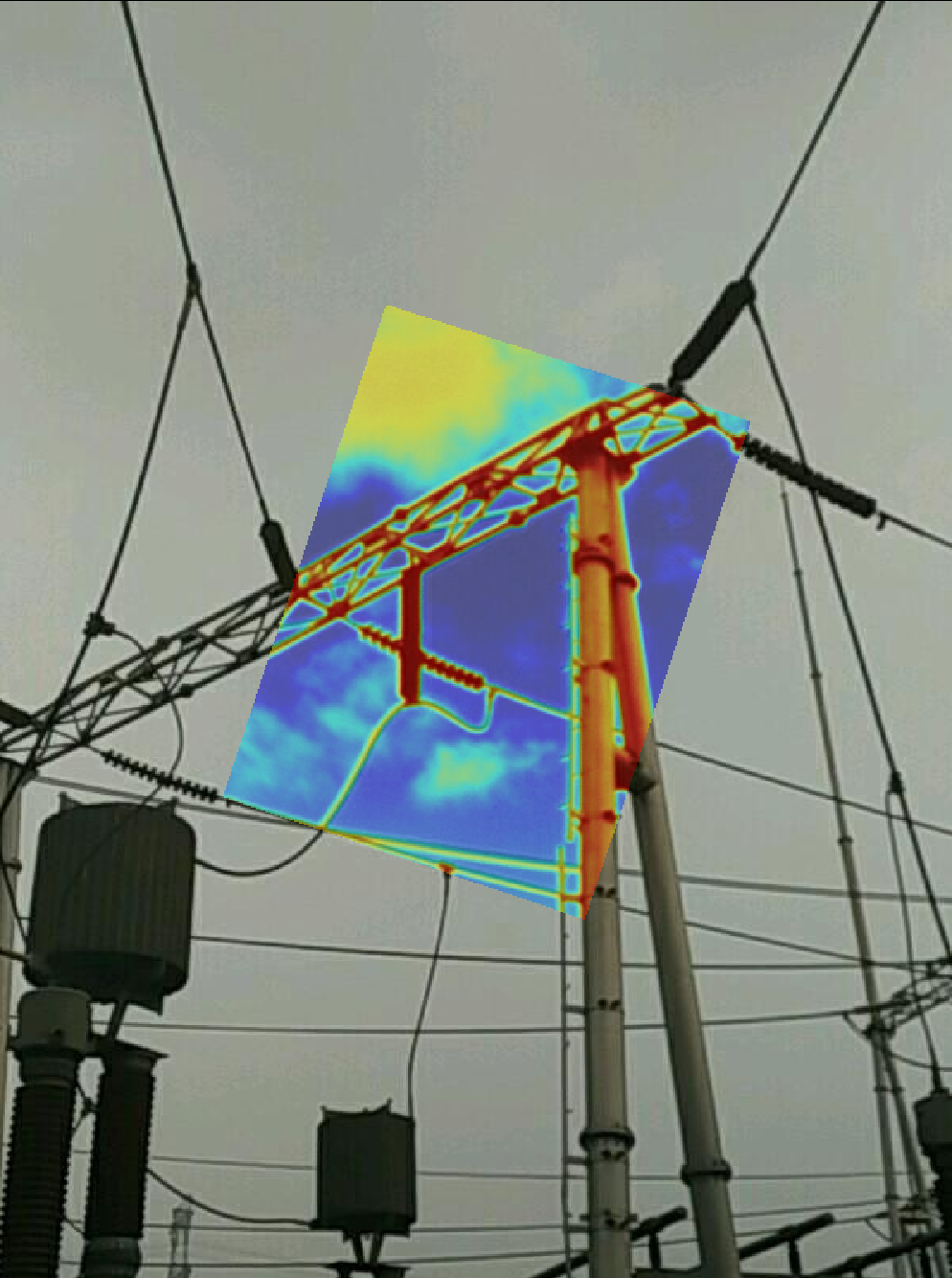

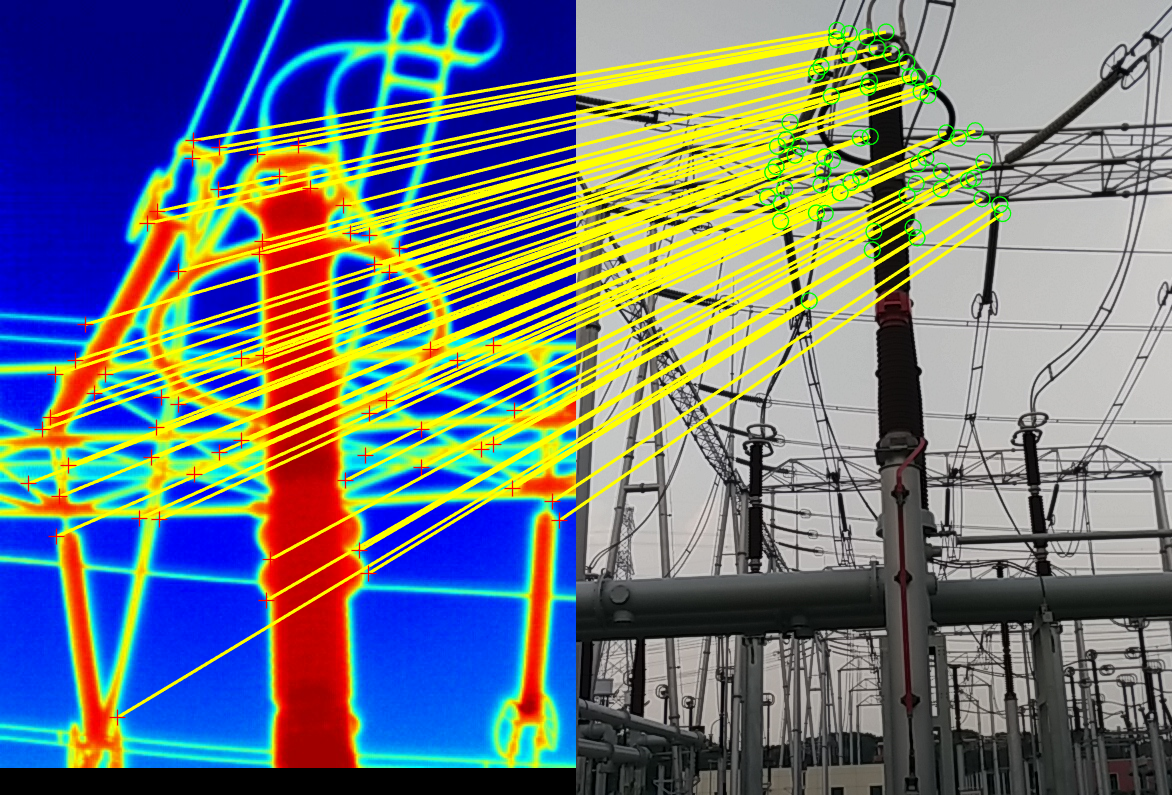

一、算法效果图

左侧为

匹配点

结果

&

右侧为

图像融合拼接

结果

1. 第1对图像

2. 第2对图像

3. 第3对图像

二、算法基本原理

本人的算法流程大概描述一下就是:

- CSS检测轮廓以及角点:利用传统的Canny边缘检测算法检测图像边缘,并使用他人的CSS变体算法(详见论文内的参考文献)提取边缘轮廓集合以及轮廓上的曲率极大值、极小值,进一步判定极大值点是否为真角点(即:特征点),此处提取的极小值点会用于下一步计算轮廓角主方向。

- 使用自己创新的主方向计算方法去计算角点的主方向:将第1步提取到的特征点分别和它左、右侧的极小值点区间内的轮廓点坐标进行高斯加权平均,主要目的是去除轮廓毛刺的影响、平滑边缘、使得可见光和红外同一个特征点的轮廓线段更加相似,然后将左右两侧加权平均得到的轮廓点和特征点分别构成两个向量,两个向量组成的角平分线方向就是本文所提的轮廓角主方向!

- 提取角点的改进SIFT描述子:因为红外和可见光图像同一条轮廓附近的梯度有反向的情况,所以将SIFT统计的0~360度区间取余为0~180区间,并且将统计完成的梯度幅值直方图进一步按照大小降序排序,将前

15

、

2

5

、

3

5

、

4

5

、

1

\frac15、\frac25、\frac35、\frac45、1

5

1

、

5

2

、

5

3

、

5

4

、

1

归一化为

1、

0.8

、

0.6

、

0.4

、

0.2

1、0.8、0.6、0.4、0.2

1

、

0

.

8

、

0

.

6

、

0

.

4

、

0

.

2

(这一步可以根据自己数据集的需求调整分段的层级,也可以细分为8份或者6份、4份之类的),举个例子:本来的SIFT描述符

[5

,

4

,

4.8

,

3

,

3.2

,

1

,

2

,

3.4

,

6

,

4

]

[5, 4, 4.8, 3, 3.2, 1, 2, 3.4,6, 4]

[

5

,

4

,

4

.

8

,

3

,

3

.

2

,

1

,

2

,

3

.

4

,

6

,

4

]

排序是

[6

,

5

,

4.8

,

4

,

4

,

3.4

,

3.2

,

3

,

2

,

1

]

[6,5,4.8,4,4,3.4,3.2,3,2,1]

[

6

,

5

,

4

.

8

,

4

,

4

,

3

.

4

,

3

.

2

,

3

,

2

,

1

]

,按照规则,归一化的SIFT描述符就变成

[1

,

0.8

,

0.8

,

0.4

,

0.4

,

0.2

,

0.2

,

0.6

,

1

,

0.6

]

[1, 0.8, 0.8, 0.4, 0.4, 0.2, 0.2, 0.6, 1, 0.6]

[

1

,

0

.

8

,

0

.

8

,

0

.

4

,

0

.

4

,

0

.

2

,

0

.

2

,

0

.

6

,

1

,

0

.

6

]

- 双边匹配描述子:常规流程,不赘述

- 去除显著的错误匹配点:因为主方向是比较准确的,所以用0~360度,以6或5度为区间的直方图统计双边匹配后的匹配特征点对之间的主方向差值,结合抛物线插值计算出最优的主方向差值角度,将红外图像旋转这个差值角度,这个时候红外和可见光图像的视野角度应该一致的,再考虑到匹配点对之间的连线和角度理论上是平行并且长度一致的,所以继续用直方图统计和抛物线插值的方法估计出正确的连线角度和长度,从而设置一定的阈值剔除不符合这个区间的匹配点对,剩下的匹配点对中错误的点就很少了,下一步用RANSAC简单跑一下就可以选出比较正确的匹配点结果。

- RANSAC获取最后的正确匹配点

上述的流程其实就是基于Point-based配准框架产生的,但是在主方向部分,为了适应图像强烈的旋转和透视差异,本人提出了一个区别于传统SIFT、SURF、PIIFD、ORB之类的主方向分配方法,简要概括就是使用轮廓特征来构建一个三角形,计算三角形的角平分线向量,这个向量的方向就分配为角点的主方向。

三、源代码下载

上述算法的

MATLAB

代码可以从Github下载:

四、参考文献

JIANG Qian, LIU Yadong, YAN Yingjie, DENG Jun, FANG Jian, LI Zhe, and JIANG Xiuchen. “A contour angle orientation for power equipment infrared and visible image registration”,

IEEE Transactions on Power Delivery

, vol. 36, no. 4, pp. 2559-2569, Aug. 2021, doi: 10.1109/TPWRD.2020.3011962.

Paper下载链接:

https://ieeexplore.ieee.org/document/9149795

或者去 ResearchGate上面Request private paper,看到消息后第一时间发给你,链接:

ResearchGate