Spark集群试运行

下面试运行Spark。

1)在Master主机上,分别启动Hadoop与Spark。

cd /usr/local/hadoop/sbin/./start-all.shcd /usr/local/spark/sbin./start-all.sh

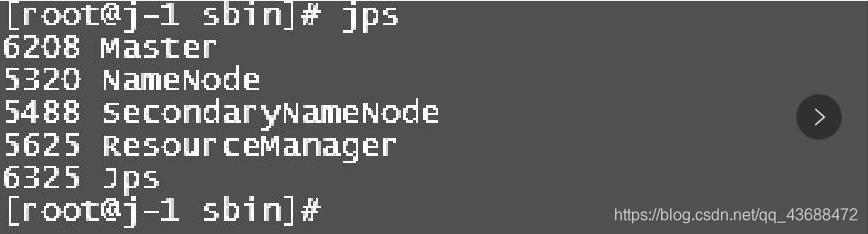

**2)检查Master与Worker进程是否在各自节点上启动。在Master主机上,执行命令jps,**如图1-5所示。

图1-5 在Master主机上执行jps命令

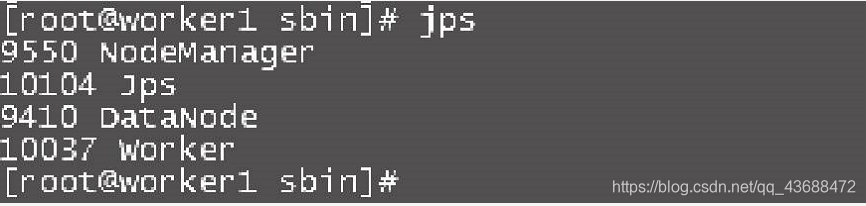

在Worker节点上,以Worker1为

执行命令jps,如图1-6所示。

图1-6 在Worker节点上执行jps命令

从图1-6中可以清晰地看到,Master进程与Worker及相关进程在各自节点上成功运行,Hadoop与Spark运行正常。

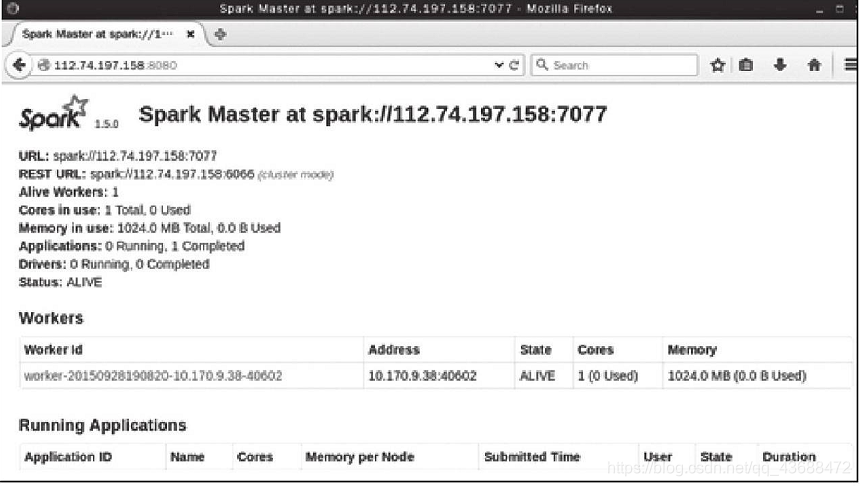

3)通过Spark Web UI查看集群状态。在浏览器中输入Master的IP与端口,打开Spark Web UI

,如图1-7所示。

Spark Web UI界面

从图1-7中可以看到,当集群内仅有一个Worker节点时,Spark Web UI显示该节点处于Alive状态,CPU Cores为1,内存为1GB。此页面会列出集群中所有启动后的Worker节点及应用的信息。

4)运行样例。Spark自带了一些样例程序可供试运行。在Spark根目录下

,example/src/main文件夹中存放着Scala、Java、Python及用R语言编写的样例,

用户可以运行其中的某个样例程序。

先拷贝到Spark根目录下,然后执行bin/run-example [class] [params]即可。

例如可以在Master主机命令行执行:

./run-example SparkPi 10

然后可以看到该应用的输出,在Spark Web UI上也可以查看应用的状态及其他信息。