1.概述

决策树(Decision Tree)是一种非参数的有监督学习方法,它能够从一系列有特征和标签的数据中总结出决策规则,并用树状图的结构来呈现这些规则,以解决分类和回归问题。

节点

根节点:没有进边,有出边。包含最初的,针对特征的提问。

中间节点:既有进边也有出边,进边只有一条,出边可以有很多条。都是针对特征的提问。

叶子节点:有进边,没有出边,每个叶子节点都是一个类别标签。

*子节点和父节点:在两个相连的节点中,更接近根节点的是父节点,另一个是子节点。

2.sklearn中的决策树

模块sklearn.tree

sklearn中决策树的类都在”tree“这个模块之下。这个模块总共包含五个类:

| tree.DecisionTreeClassifier | 分类树 |

| tree.DecisionTreeRegressor | 回归树 |

| tree.export_graphviz | 将生成的决策树导出为DOT格式,画图专用 |

| tree.ExtraTreeClassifier | 高随机版本的分类树 |

| tree.ExtraTreeRegressor | 高随机版本的回归树 |

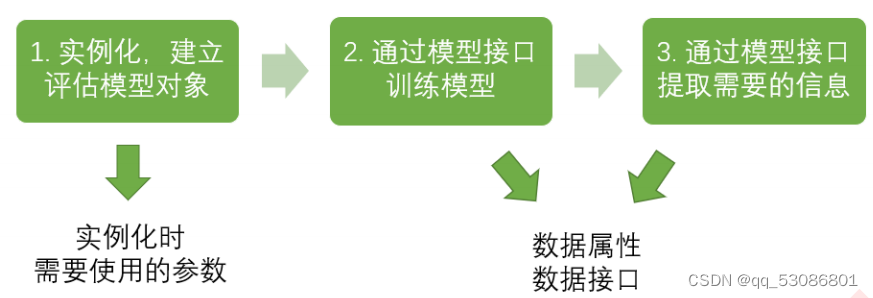

sklearn建模的基本流程

对应的代码:

from sklearn import tree #导入需要的模块

clf = tree.DecisionTreeClassifier() #实例化

clf = clf.fit(X_train,y_train) #用训练集数据训练模型

result = clf.score(X_test,y_test) #导入测试集,从接口中调用需要的信息

2.1分类树DecisionTreeClassifier

sklearn.tree.DecisionTreeClassifier (criterion=’gini’

, splitter=’best’

,max_depth=None

,min_samples_split=2

, min_samples_leaf=1

, min_weight_fraction_leaf=0.0

, max_features=None

,random_state=None

, max_leaf_nodes=None

, min_impurity_decrease=0.0

, min_impurity_split=None

,class_weight=None

, presort=False

)

2.1.1 重要参数

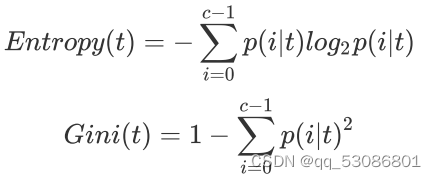

(1)criterion

为了要将表格转化为一棵树,决策树需要找出最佳节点和最佳的分枝方法,对分类树来说,衡量这个“最佳”的指标叫做

“不纯度”

。通常来说,不纯度越低,决策树对训练集的拟合越好。现在使用的决策树算法在分枝方法上的核心大多是围绕在对某个不纯度相关指标的最优化上。

不纯度基于节点来计算,树中的每个节点都会有一个不纯度,并且子节点的不纯度一定是低于父节点的,也就是说,在同一棵决策树上,叶子节点的不纯度一定是最低的。

Criterion参数决定不纯度的计算方法。sklearn提供了两种选择:

1)输入”entropy“,使用

信息熵

(Entropy)

2)输入”gini“,使用

基尼系数

(Gini Impurity)

当使用信息熵时,sklearn实际计算的是基于信息熵的信息增益(Information Gain),即父节点的信息熵和子节点的信息熵之差。

比起基尼系数,信息熵对不纯度更加敏感,对不纯度的惩罚最强。但是在实际使用中,信息熵和基尼系数的效果基本相同。信息熵的计算比基尼系数缓慢一些,因为基尼系数的计算不涉及对数。

信息熵对不纯度更加敏感,所以信息熵作为指标时,决策树的生长会更加“精细”,因此对于高维数据或者噪音很多的数据,信息熵很容易过拟合,基尼系数在这种情况下效果往往比较好。当模型拟合程度不足的时候,即当模型在训练集和测试集上都表现不太好的时候,使用信息熵。

| 参数 | criterion |

|---|---|

| 如何影响模型 | 确定不纯度的计算方法,帮忙找出最佳节点和最佳分枝,不纯度越低,决策树对训练集的拟合越好 |

| 可能的输入有哪些 | 不填默认基尼系数,填写gini使用基尼系数,填写entropy使用信息增益 |

| 怎样选取参数 |

通常就使用基尼系数数据维度很大,噪音很大时使用基尼系数 维度低,数据比较清晰的时候,信息熵和基尼系数没区别 当决策树的拟合程度不够的时候,使用信息熵 两个都试试,不好就换另外一个 |

例.红酒数据集分类

- 导入需要的算法库和模块

from sklearn import tree #导入模块

from sklearn.datasets import load_wine #导入红酒数据集

from sklearn.model_selection import train_test_split

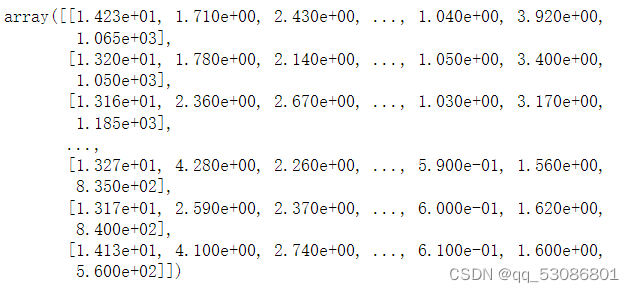

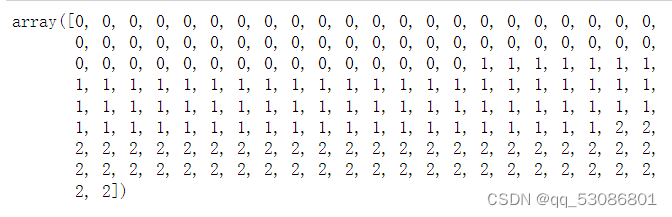

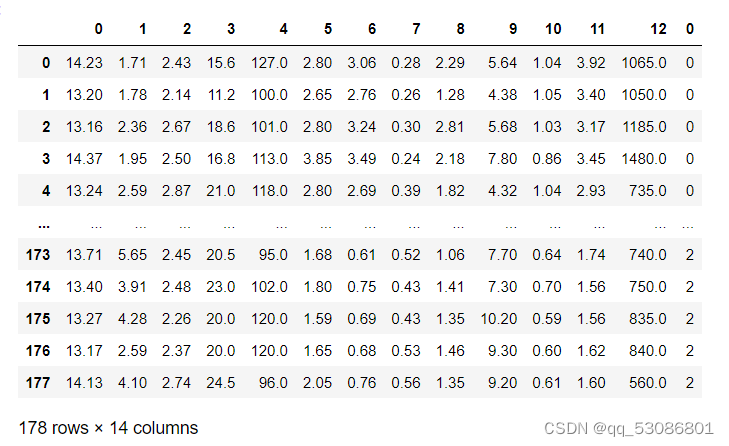

- 查看数据

wine.data#特征值

wine.target#标签值

查看wine表

import pandas as pd

pd.concat([pd.DataFrame(wine.data),pd.DataFrame(wine.target)],axis=1)

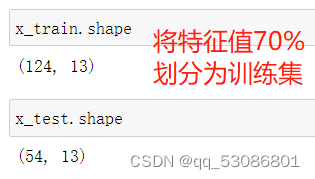

- 划分数据集为训练集和测试集

#划分数据集

x_train,x_test,y_train,y_test = train_test_split(wine.data,wine.target,test_size=0.3)

- 建立模型

#实例化模型

clf = tree.DecisionTreeClassifier(criterion='entropy')

#使用fit方法训练模型

clf = clf.fit(x_train,y_train)

#模型评估

score = clf.score(x_test,y_test)

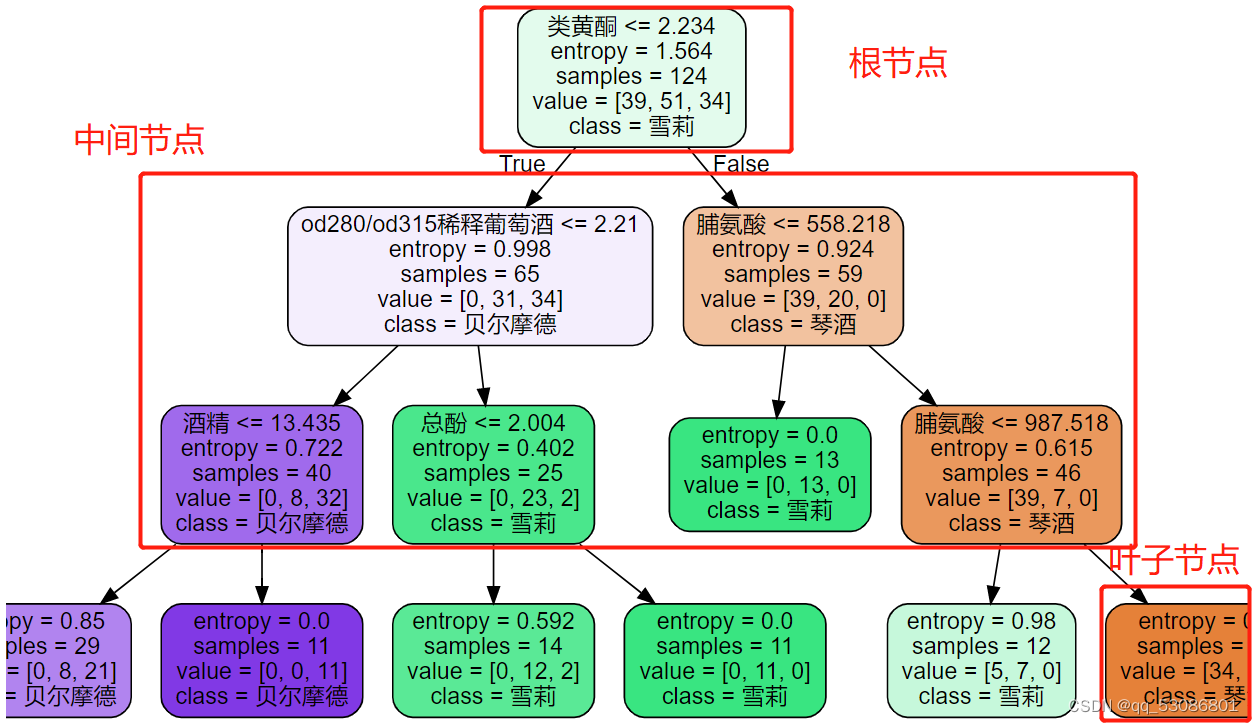

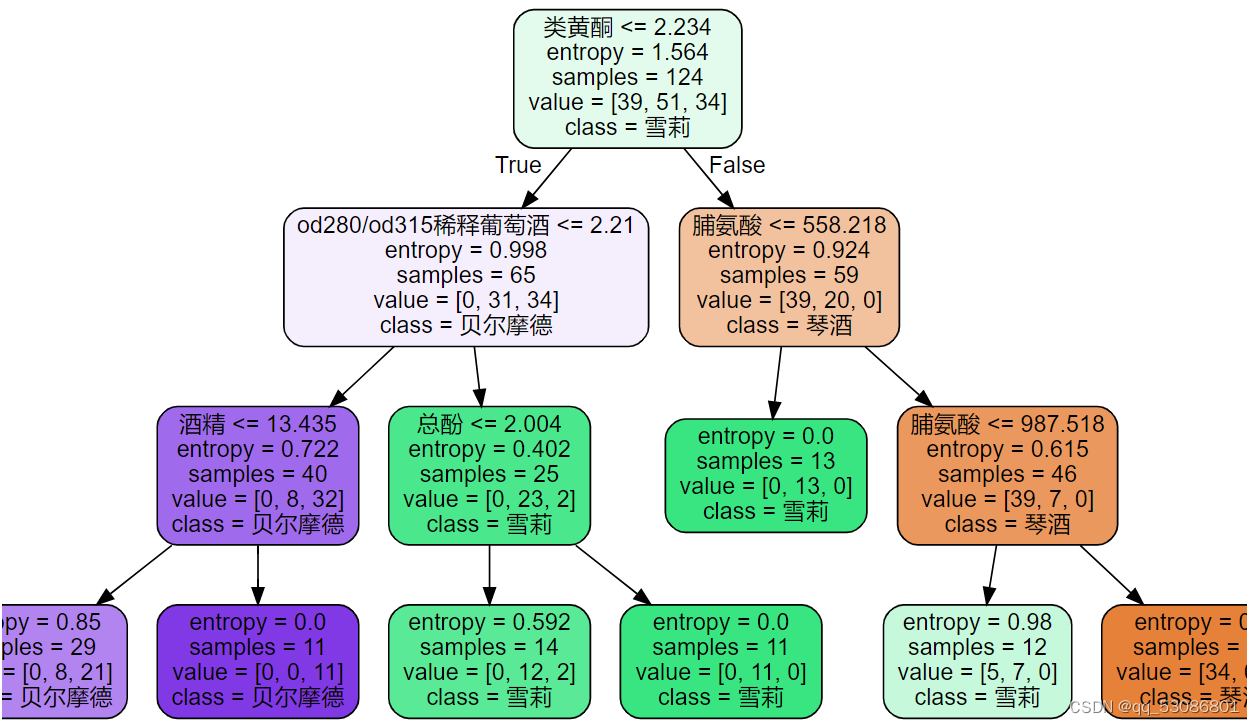

- 画决策树

import graphviz

feature_name = ['酒精','苹果酸','灰','灰的碱性','镁','总酚','类黄酮','非黄烷类酚类','花青素','颜色强度','色调','od280/od315稀释葡萄酒','脯氨酸']

dot_data = tree.export_graphviz(clf

,feature_names=feature_name

,class_names=["琴酒","雪莉","贝尔摩德"]

,filled=True

,rounded=True

)#filled是否填充颜色, rounded框是否圆角

graph = graphviz.Source(dot_data)

graph

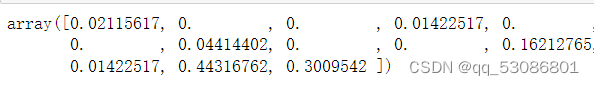

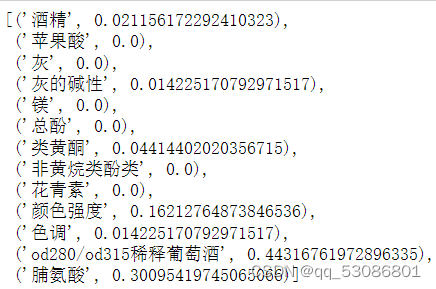

- 查看特征重要性

# 不同特征重要性

clf.feature_importances_

# 特征名字和对应重要性

[*zip(feature_name,clf.feature_importances_)]

sklearn在每次分枝时不使用全部特征,而是随机选取一部分特征,从中选取不纯度相关指标最优的作为分枝用的节点,因此每次生成的树也不同。

为了保证生成的树相同保持模型良好的泛化性,要使用 random_state 参数控制决策树随机度。

(2)random_state

random_state用来设置分枝中的随机模式的参数,默认None,在高维度时随机性会表现更明显,低维度的数据(比如鸢尾花数据集),随机性几乎不会显现。输入任意整数,会一直长出同一棵树,让模型稳定下来。

# random_state随机数种子控制决策树随机度

#实例化模型

clf = tree.DecisionTreeClassifier(criterion='entropy'

,random_state=15)#模型本身也是随机的

#使用fit方法训练模型

clf = clf.fit(x_train,y_train)

#模型评估

score = clf.score(x_test,y_test)

score

(3)splitter

splitter也是用来控制决策树中的随机选项的。

有两种输入值:

输入”best”,决策树在分枝时虽然随机,但是还是会优先选择更重要的特征进行分枝(重要性可以通过属性feature_importances_查看)

输入“random”,决策树在分枝时会更加随机,树会因为含有更多的不必要信息而更深更大,并因这些不必要信息而降低对训练集的拟合。这也是防止过拟合的一种方式。当你预测到你的模型会过拟合,用这两个参数来帮助你降低树建成之后过拟合的可能性。当然,树一旦建成,我们依然是使用剪枝参数来防止过拟合。

clf = tree.DecisionTreeClassifier(criterion='entropy'

,random_state=20

,splitter='random'

)

clf = clf.fit(x_train, y_train)

score = clf.score(x_test, y_test)

score

2.1.2 剪枝参数(防止过拟合)

在不加限制的情况下,一棵决策树会生长到衡量不纯度的指标最优,或者没有更多的特征可用为止。这样的决策树往往会过拟合,这就是说,

它会在训练集上表现很好,在测试集上却表现糟糕

。我们收集的样本数据不可能和整体的状况完全一致,因此当一棵决策树对训练数据有了过于优秀的解释性,它找出的规则必然包含了训练样本中的噪声,并使它对未知数据的拟合程度不足。

通过对比训练集和测试集的准确度判断是否过拟合

# 训练集准确度

score_train = clf.score(x_train, y_train)

score_train

# 测试集准确度

score_test = clf.score(x_test, y_test)

score_test

剪枝策略对决策树的影响巨大,正确的剪枝策略是优化决策树算法的核心。

(1)max_depth

限制树的最大深度,超过设定深度的树枝全部剪掉

这是用得最广泛的剪枝参数,在高维度低样本量时非常有效。决策树多生长一层,对样本量的需求会增加一倍,所以限制树深度能够有效地限制过拟合。在集成算法中也非常实用。实际使用时,建议从=3开始尝试,看看拟合的效果再决定是否增加设定深度。

(2)min_samples_leaf

min_samples_leaf限定,一个节点在分枝后的每个子节点都必须包含至少min_samples_leaf个训练样本,否则分枝就不会发生,或者,分枝会朝着满足每个子节点都包含min_samples_leaf个样本的方向去发生

这个参数的数量设置得太小会引起过拟合,设置得太大就会阻止模型学习数据。一般来说,建议从=5开始使用。如果叶节点中含有的样本量变化很大,建议输入浮点数作为样本量的百分比来使用。同时,这个参数可以保证每个叶子的最小尺寸,可以在回归问题

中避免低方差,过拟合的叶子节点出现。对于类别不多的分类问题,=1通常就是最佳选择。

(3)min_samples_split

min_samples_split限定,一个节点必须要包含至少min_samples_split个训练样本,这个节点才允许被分枝,否则分枝就不会发生。

# max_depth 限制树的最大深度,超过设定深度的树枝全部剪掉

clf = tree.DecisionTreeClassifier(criterion="entropy"

,random_state=30

,splitter="random"

,max_depth=3

,min_samples_leaf=10

,min_samples_split=10

)

clf = clf.fit(x_train, y_train)

dot_data = tree.export_graphviz(clf

,feature_names= feature_name

,class_names=["琴酒","雪莉","贝尔摩德"]

,filled=True

,rounded=True)

graph = graphviz.Source(dot_data)

graph

(4)max_features

max_features限制分枝时考虑的特征个数,超过限制个数的特征都会被舍弃。和max_depth异曲同工,max_features是用来限制高维度数据的过拟合的剪枝参数,但其方法比较暴力,是直接限制可以使用的特征数量而强行使决策树停下的参数,在不知道决策树中的各个特征的重要性的情况下,强行设定这个参数可能会导致模型学习不足。如果希望通过降维的方式防止过拟合,建议使用PCA,ICA或者特征选择模块中的降维算法。

(5)min_impurity_decrease

min_impurity_decrease限制信息增益的大小,信息增益小于设定数值的分枝不会发生。

确认最优的剪枝参数

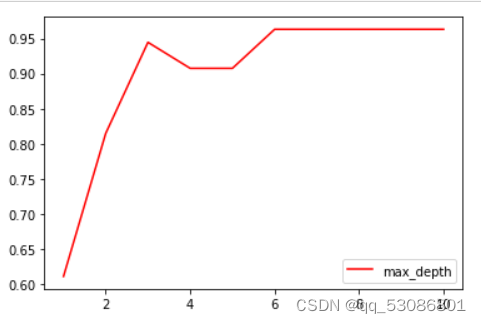

使用超参数的曲线来进行判断最优的剪枝参数。超参数的学习曲线,是一条以超参数的取值为横坐标,模型的度量指标为纵坐标的曲线,它是用来衡量不同超参数取值下模型的表现的线。在建好的决策树里,模型度量指标就是score。

# 超参数的学习曲线

import matplotlib.pyplot as plt

test = []

for i in range(10):

clf = tree.DecisionTreeClassifier(max_depth=i+1

,criterion="entropy"

,random_state=30

,splitter="random"

)

clf = clf.fit(x_train, y_train)

score = clf.score(x_test, y_test)

test.append(score)

plt.plot(range(1,11),test,color="red",label="max_depth")

plt.legend()

plt.show()

2.1.3 目标权重参数

class_weight & min_weight_fraction_leaf

完成样本标签平衡的参数。样本不平衡是指在一组数据集中,标签的一类天生占有很大的比例。比如说,在银行要判断“一个办了信用卡的人是否会违约”,就是是vs否(1%:99%)的比例。这种分类状况下,即便模型什么也不做,全把结果预测成“否”,正确率也能有99%。因此我们要使用class_weight参数对样本标签进行一定的均衡,给少量的标签更多的权重,让模型更偏向少数类,向捕获少数类的方向建模。该参数默认None,此模式表示自动给与数据集中的所有标签相同的权重。

有了权重之后,样本量就不再是单纯地记录数目,而是受输入的权重影响了,因此这时候剪枝,就需要搭配min_weight_fraction_leaf这个基于权重的剪枝参数来使用。另请注意,基于权重的剪枝参数(例如min_weight_fraction_leaf)将比不知道样本权重的标准(比如min_samples_leaf)更少偏向主导类。如果样本是加权的,则使用基于权重的预修剪标准来更容易优化树结构,这确保叶节点至少包含样本权重的总和的一小部分。

2.1.4 重要属性和接口

属性是在模型训练之后,能够调用查看的模型的各种性质。

决策树最重要的属性:

feature_importances_,能够查看各个特征对模型的重要性。

四个接口:

fit,score,apply,predict

sklearn中许多算法的接口都是相似的,比如说我们之前已经用到的fit和score,几乎对每个算法都可以使用。除了这两个接口之外,决策树最常用的接口还有apply和predict。

apply中输入测试集返回每个测试样本所在的叶子节点的索引。

predict输入测试集返回每个测试样本的标签。

#apply返回每个测试样本所在的叶子节点的索引

clf.apply(x_test)

#predict返回每个测试样本的分类/回归结果

clf.predict(x_test)

2.2 回归树 DecisionTreeRegressor

sklearn.tree.DecisionTreeRegressor (criterion=’mse’

, splitter=’best’

, max_depth=None

,min_samples_split=2

, min_samples_leaf=1

, min_weight_fraction_leaf=0.0

, max_features=None

,random_state=None

, max_leaf_nodes=None

, min_impurity_decrease=0.0

, min_impurity_split=None

, presort=False

)

在回归树种,没有标签分布是否均衡的问题,因此没有class_weight这样的参数。

2.2.1重要参数,属性及接口

criterion

回归树衡量分枝质量的指标,支持的标准有三种:

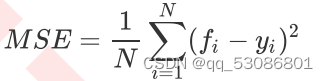

1)输入”mse”使用均方误差mean squared error(MSE),父节点和叶子节点之间的均方误差的差额将被用来作为特征选择的标准,这种方法通过使用叶子节点的均值来最小化L2损失

2)输入“friedman_mse”使用费尔德曼均方误差,这种指标使用弗里德曼针对潜在分枝中的问题改进后的均方误差

3)输入”mae”使用绝对平均误差MAE(mean absolute error),这种指标使用叶节点的中值来最小化L1损失

属性中最重要的依然是feature_importances_

接口依然是apply, fit, predict, score最核心

其中N是样本数量,i是每一个数据样本,fi是模型回归出的数值,yi是样本点i实际的数值标签。

MSE的本质,是样本真实数据与回归结果的差异。

在回归树中,MSE不只是分枝质量衡量指标,也是最常用的衡量回归树回归质量的指标。

当使用交叉验证,或者其他方式获取回归树的结果时,往往选择均方误差作为评估指标(在分类树中这个指标是score代表的预测准确率)。

在回归中,我们追求的是,MSE越小越好。

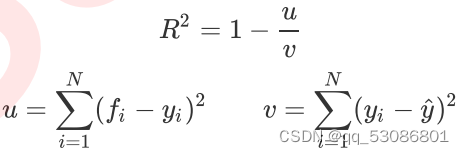

回归树的接口score返回的是R平方,并不是MSE。

R平方被定义如下:

其中u是残差平方和(MSE * N),v是总平方和,N是样本数量,i是每一个数据样本,fi是模型回归出的数值,yi是样本点i实际的数值标签。y帽是真实数值标签的平均数。

R平方可以为正为负(如果模型的残差平方和远远大于模型的总平方和,模型非常糟糕,R平方就会为负),而均方误差永远为正。

虽然均方误差永远为正,但是sklearn当中使用均方误差作为评判标准时,却是计算”负均方误差“(neg_mean_squared_error)。这是因为sklearn在计算模型评估指标的时候,会考虑指标本身的性质,均方误差本身是一种误差,所以被sklearn划分为模型的一种损失(loss),因此在sklearn当中,都以负数表示。真正的均方误差MSE的数值,其实就是neg_mean_squared_error去掉负号的数字。

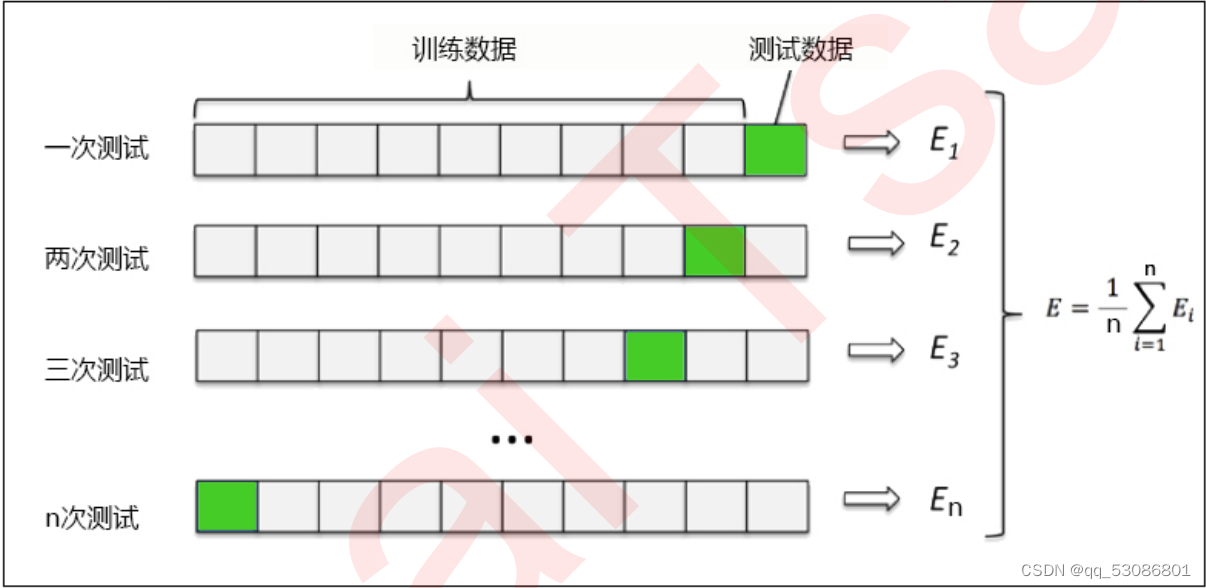

使用交叉验证的回归树

from sklearn.datasets import load_boston

from sklearn.model_selection import cross_val_score

from sklearn.tree import DecisionTreeRegressor

boston = load_boston()

regressor = DecisionTreeRegressor(random_state=0)

cross_val_score(regressor #实例化的模型

, boston.data #完整的特征值

, boston.target #完整的目标值

, cv=10 #几折交叉验证

,scoring = "neg_mean_squared_error" #对于回归,默认返回R²。在回归交叉验证要使用MSE

)

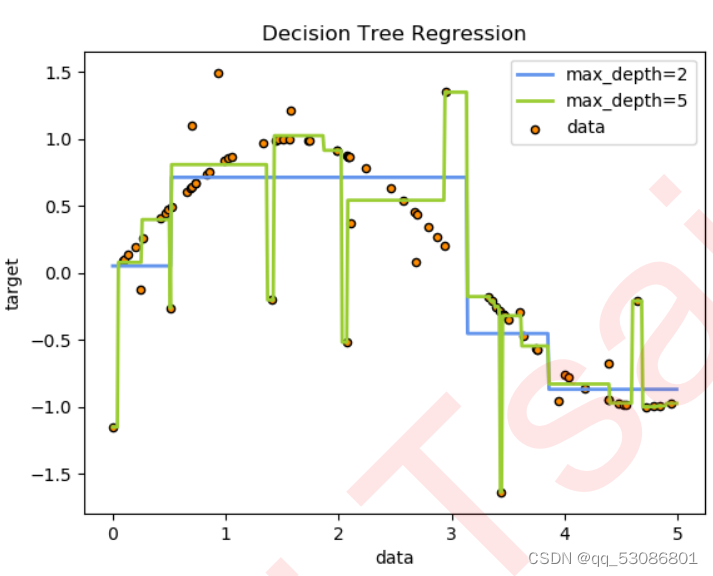

例:一维回归的图像绘制

用回归树来拟合正弦曲线,并添加一些噪声来观察回归树的表现

# 1. 导入需要的库

import numpy as np

from sklearn.tree import DecisionTreeRegressor

import matplotlib.pyplot as plt

# 2. 创建一条含有噪声的正弦曲线

rng = np.random.RandomState(1) #随机数种子

X = np.sort(5 * rng.rand(80,1), axis=0) # rng.rand(80,1)生成一个二维数组,np.sort排序

y = np.sin(X).ravel()

y[::5] += 3 * (0.5 - rng.rand(16)) #加噪声数据

#np.random.rand(数组结构),生成随机数组的函数

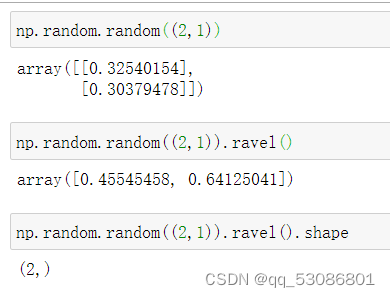

降维函数ravel()的用法:

# 3. 实例化&训练模型

regr_1 = DecisionTreeRegressor(max_depth=2)

regr_2 = DecisionTreeRegressor(max_depth=5)

regr_1.fit(X, y)

regr_2.fit(X, y)

# 4. 测试集导入模型,预测结果

X_test = np.arange(0.0, 5.0, 0.01)[:, np.newaxis]

y_1 = regr_1.predict(X_test)

y_2 = regr_2.predict(X_test)

#np.arrange(开始点,结束点,步长) 生成有序数组的函数

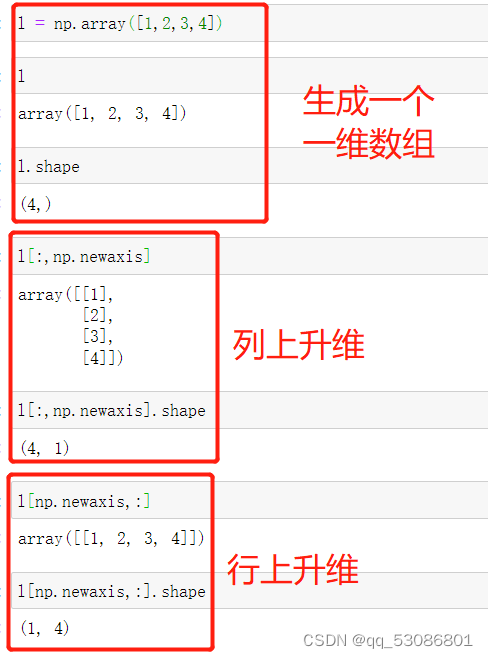

增维切片np.newaxis的用法:

# 绘制图像

plt.figure()

plt.scatter(X, y, s=20, edgecolor="black",c="darkorange", label="data")

plt.plot(X_test, y_1, color="cornflowerblue",label="max_depth=2", linewidth=2)

plt.plot(X_test, y_2, color="yellowgreen", label="max_depth=5", linewidth=2)

plt.xlabel("data")

plt.ylabel("target")

plt.title("Decision Tree Regression")

plt.legend()

plt.show()

实例:泰坦尼克号幸存者的预测

- 导入所需要的库

import pandas as pd

from sklearn.tree import DecisionTreeClassifier

from sklearn.model_selection import train_test_split

from sklearn.model_selection import GridSearchCV

from sklearn.model_selection import cross_val_score

import matplotlib.pyplot as plt

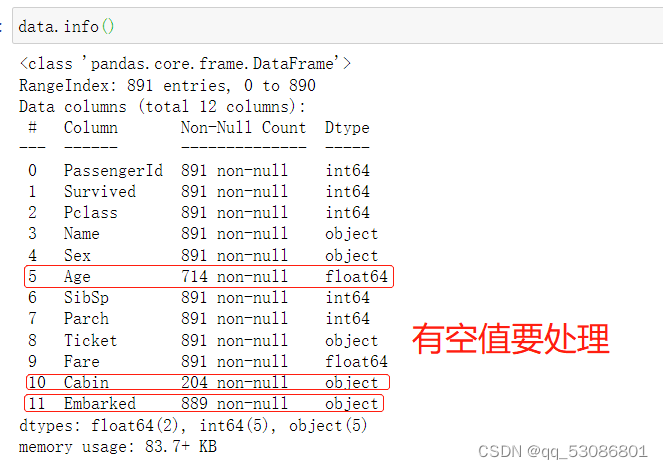

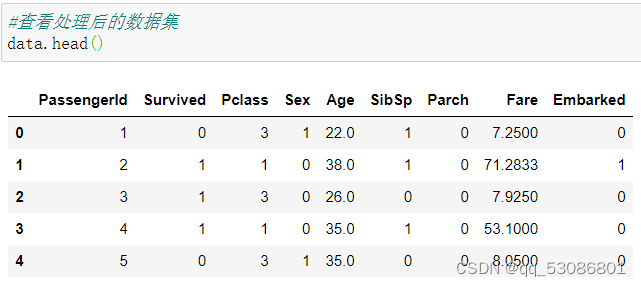

- 导入数据集,探索数据

data = pd.read_csv("F:/jupyter notebook/data.csv")

- 对数据集进行预处理

#删除缺失值过多的列,和观察判断来说和预测的y没有关系的列

data.drop(["Cabin","Name","Ticket"],inplace=True,axis=1) #处理缺失值,对缺失值较多的列进行填补,有一些特征只确实一两个值,可以采取直接删除记录的方法

data["Age"] = data["Age"].fillna(data["Age"].mean())

data = data.dropna()

将分类变量转换为数值型变量

#将二分类变量转换为数值型变量

#astype能够将一个pandas对象转换为某种类型,和apply(int(x))不同,astype可以将文本类转换为数字,用这个方式可以很便捷地将二分类特征转换为0~1

data["Sex"] = (data["Sex"]== "male").astype("int")

#将三分类变量转换为数值型变量

labels = data["Embarked"].unique().tolist()

data["Embarked"] = data["Embarked"].apply(lambda x: labels.index(x))

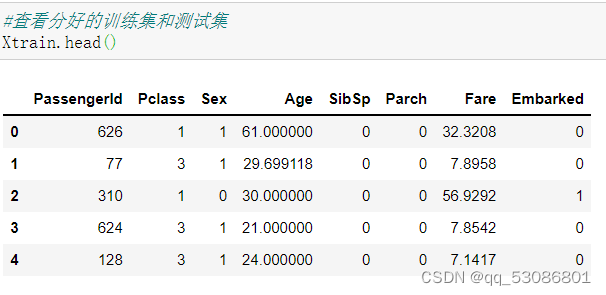

- 提取标签和特征矩阵,分测试集和训练集

X = data.iloc[:,data.columns != "Survived"]

y = data.iloc[:,data.columns == "Survived"]

from sklearn.model_selection import train_test_split

Xtrain, Xtest, Ytrain, Ytest = train_test_split(X,y,test_size=0.3)

#修正测试集和训练集的索引

for i in [Xtrain, Xtest, Ytrain, Ytest]:

i.index = range(i.shape[0])

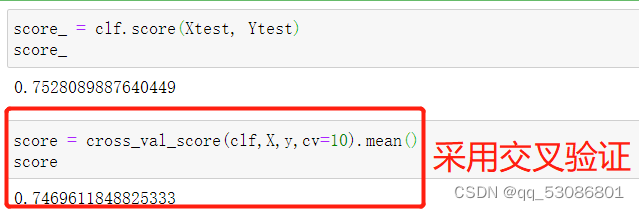

- 导入模型,粗略跑一下查看结果

clf = DecisionTreeClassifier(random_state=25)

clf = clf.fit(Xtrain, Ytrain)

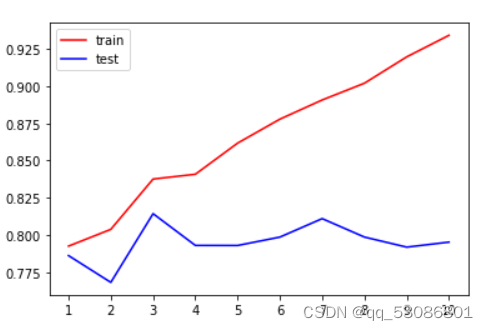

- 在不同max_depth下观察模型的拟合状况

tr = []

te = []

for i in range(10):

clf = DecisionTreeClassifier(random_state=25

,max_depth=i+1

,criterion="entropy"

)

clf = clf.fit(Xtrain, Ytrain)

score_tr = clf.score(Xtrain,Ytrain)

score_te = cross_val_score(clf,X,y,cv=10).mean()

tr.append(score_tr)

te.append(score_te)

print(max(te))

plt.plot(range(1,11),tr,color="red",label="train")

plt.plot(range(1,11),te,color="blue",label="test")

plt.xticks(range(1,11))

plt.legend()

plt.show()

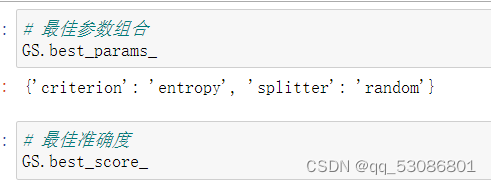

- 用网格搜索调整参数

import numpy as np

gini_thresholds = np.linspace(0,0.5,20)

parameters = {'splitter':('best','random')

,'criterion':("gini","entropy")

}

clf = DecisionTreeClassifier(random_state=25)

GS = GridSearchCV(clf, parameters, cv=10)

GS.fit(Xtrain,Ytrain)