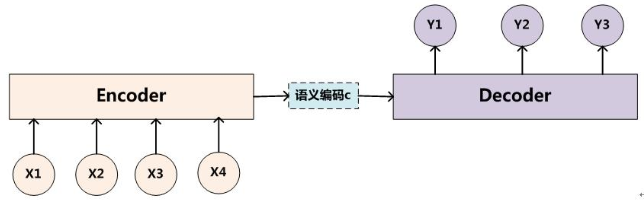

一、编码-解码架构

目的:解决语音识别、机器翻译、知识问答等输出输入序列长度不相等的任务。

C是输入的一个表达(representation),包含了输入序列的有效信息。

- 它可能是一个向量,也可能是一个固定长度的向量序列;

- 如果C是一个向量序列,则它和输入序列的区别在于:序列C是定长的、较短的;而输入序列是不定长的、较长的。

二、注意力机制

1.attention

2.local attention

3.self attention

4.Hierarchical attention

转载于:https://www.cnblogs.com/nxf-rabbit75/p/11555683.html