BCELoss:

-

CE和

B

CE:CrossEntropy。

B:binary

,即用于

二分类问题

-

输入:

-

Sigmoid:

-

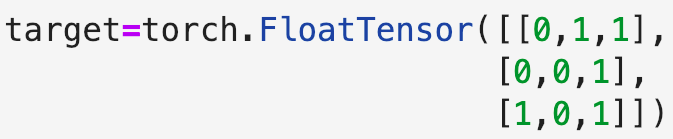

目标:

-

损失函数:

BCEWithLogitsLoss:

- 就是把Sigmoid-BCELoss合成一步

-

BPRLoss:

-

推荐系统领域有两个问题:Raking和Rating

- Ranking:Top-N的推荐

- Rating:预测物品打分

-

最新研究都是做排序的:

- 排序比较贴近实际

- 评分预测最后训练的模型会遇到过拟合问题(即,最后预测的评分都是一样的)

-

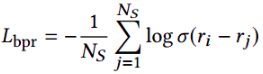

损失函数思想:让

正样本和负样本

之间的

得分之差

尽可能地大 -

公式:

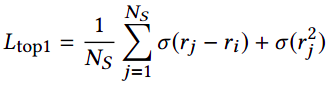

TOP1Loss:

- 一种启发式的组合损失函数

- 第一部分旨在将目标分数提升到样本分数以上

-

第二部分则将负样本的分数降低到零。第二部分其实就是一个正则项,但是并没有直接约束权重,它惩罚了负样本的得分。

因为所有的物品都有可能作为某一个用户的负样本

。 -

参考博文:

https://blog.csdn.net/qq_22210253/article/details/85222093

版权声明:本文为weiwei935707936原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。