山东大学软件学院2022-2023第二学期深度学习及应用期末考试回忆版

前言

1、考试时间:2023/6/8 16:10 – 18:10

2、考试科目:深度学习及应用(老师:ZhangXinXin)

3、考题语言:中文

4、考试形式:闭卷

5、题型:名词解释、简答、计算

6、考后感悟:总体而言,考试比较简单。但是复习过程比较麻烦,主要是内容太多了。

7、笔记:

深度学习期末复习

一、名词解释(4*5’=20’)

1、权重衰减

对大的权重进行惩罚、来抑制过拟合。

2、分布式假设

某个单词的含义由它周围的单词组成。

3、随机梯度下降

使用随机选择的mini batch数据,沿梯度方向更新参数,并重复步骤多次,从而逐渐靠近最优参数的过程叫做SGD。

4、梯度消失

梯度的大小随时间步长呈指数级减少。

二、简答题(6*10’=60’)

1、写出损失函数的定义,并给出两个损失函数。

答:用来估量模型的输出与真实值之间的差距,给模型的优化指引方向,即损失函数。

均方误差:

E =

1

2

∑

k

(

y

k

−

t

k

)

2

\frac{1}{2} \sum_{k} ({y_k – t_k} )^2

2

1

∑

k

(

y

k

−

t

k

)

2

交叉熵误差:前者为单个数据,后者为全部数据

E

=

−

∑

k

t

k

log

y

k

E = -\sum_{k} t_k \log_{}{y_k}

E

=

−

∑

k

t

k

lo

g

y

k

\space

E

=

−

1

N

∑

n

∑

k

t

n

k

log

y

n

k

E = – \frac{1}{N}\sum_{n}\sum_{k} t_{nk} \log_{}{y_{nk}}

E

=

−

N

1

∑

n

∑

k

t

nk

lo

g

y

nk

2、CNN的池化操作及其特性。

池化是缩小高、长方向上的空间的运算。有最大池化、平均池化。

特性:

1. 没有要学习的参数。

2. 通道数不发生变化。

3. 对微小的位置变化具有鲁棒性(健壮)。

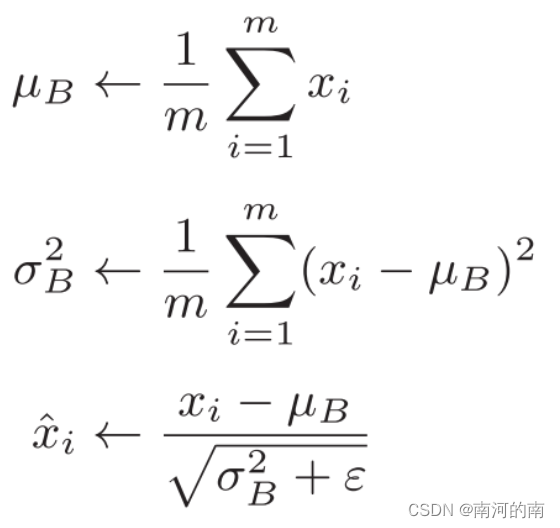

3、Batch-Normalization的原理及计算过程。

答:为以进行学习时的mini-batch为单位,按mini-batch进行正规化。具体而言,就是进行使数据分布的均值为0、方差为1的正规化。

4、循环神经网络和卷积神经网络的不同点。

1.RNN主要用于序列数据的处理,例如自然语言文本、时间序列数据等;RNN的主要特点是它可以将前面的信息传递到后面的计算中,因此它可以捕捉到序列数据中的时间依赖关系。

2.CNN主要用于图像和语音等信号数据的处理;CNN的输入和输出都是一个固定大小的张量;CNN的主要特点是它可以通过卷积操作来提取图像中的局部特征,并且可以通过池化操作来减少特征图的大小。

5、sigmod函数和阶跃函数的相同点及不同点。

相同点:

1. 二者都是非线性函数

2. 输入较小时,输出接近0;输入较大时,输出接近1。

不同点:

1. 二者平滑性不同

2. 阶跃函数只能返回0或1信号,而sigmod函数可以返回0-1之间的实数

3. sigmod的导数在任何地方都不为0,阶跃函数的导数在绝大多数地方都为0。

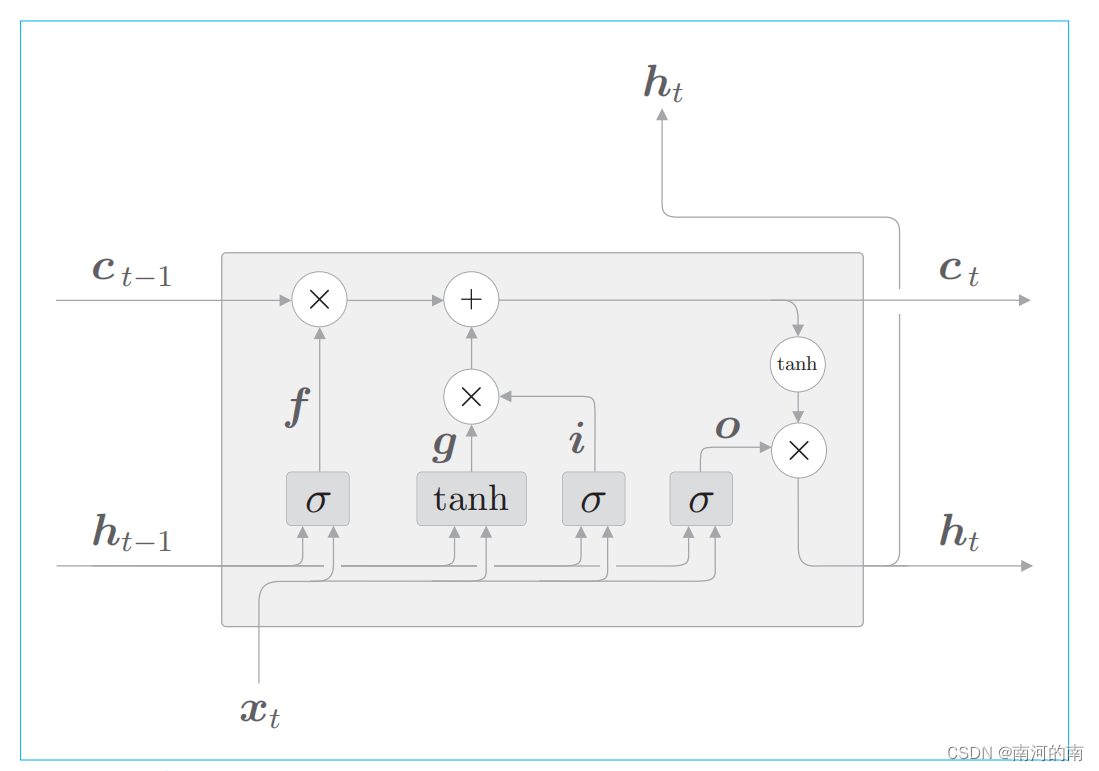

6、画出LSTM的基本基本结构,并说明三个门的作用。

答:

1.输出门:管理下一个隐藏状态ht的输出的门

2.遗忘门:忘记不必要记忆的门

3.输入门:判断新增信息 g 的各个元素的价值有多大。输入门不会不经考虑就添加新信息,而是会对要添加的信息进行取舍。

三、计算题

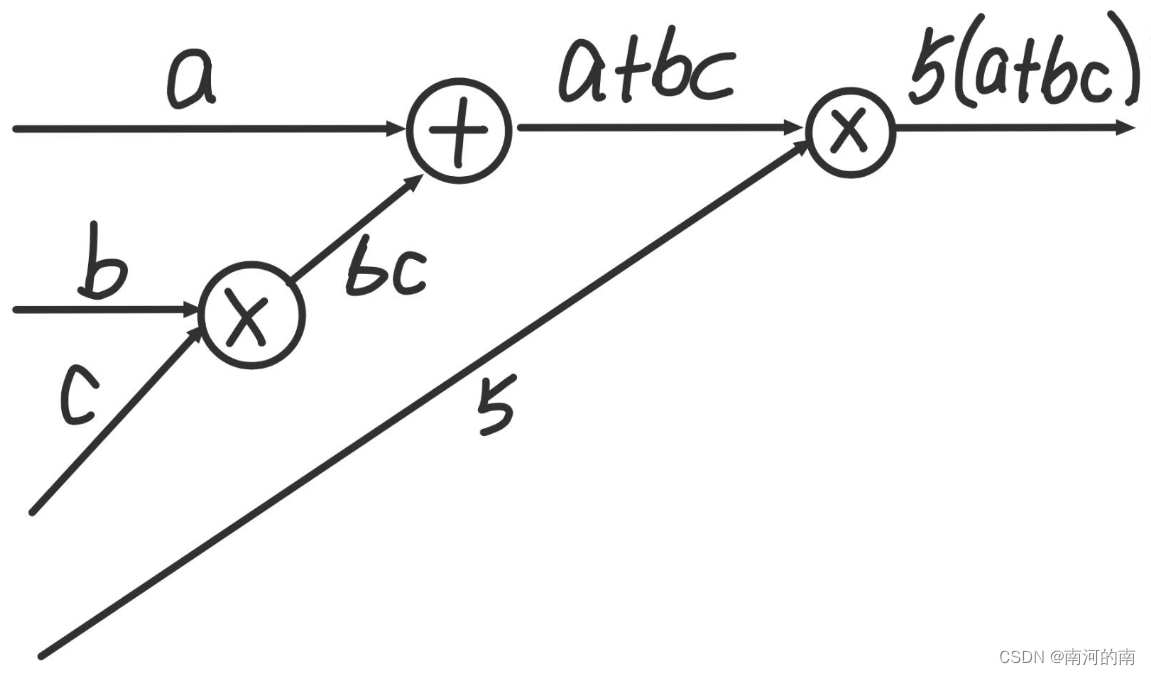

给出函数f(a,b,c)=5(a+bc),完成下面计算。

(1) 画出计算图。当a=7,b=5,c=3时,输出结果为多少?

(2)根据计算图,计算

d

f

d

a

\frac{df}{da}

d

a

df

,

d

f

d

b

\frac{df}{db}

d

b

df

,

d

f

d

c

\frac{df}{dc}

d

c

df

。

答:

当a=7,b=5,c=3时,输出结果为5*(7+5*3)=110

(2)

d

f

d

a

\frac{df}{da}

d

a

df

= 5 ;

d

f

d

b

\frac{df}{db}

d

b

df

= 5c ;

d

f

d

c

\frac{df}{dc}

d

c

df

= 5b

结尾

考题并不是很难,但是要准备复习的东西比较多。

注:以上题目的答案均个人理解,如有错误,欢迎指出。

点

个

赞

呗

~

点

个

赞

呗

~

点

个

赞

呗

~