目录

一、ONNX简介

它是微软和Facebook提出的一种表示深度学习模型的开放格式,定义了一套独立于环境和平台的标准格式。

二、

使用场景

无论你使用什么样的训练框架来训练模型(比如TensorFlow/Pytorch/OneFlow/Paddle),你都可以在训练后将这些框架的模型统一转为ONNX存储。 ONNX文件不仅存储了神经网络模型的权重,还存储了模型的结构信息、网络中各层的输入输出等一些信息。 然后将转换后的ONNX模型,转换成我们需要使用不同框架部署的类型,通俗来说ONNX 相当于一个翻译。

三、常见例子

•

Pytorch

-> ONNX ->

TensorRT

•

Pytorch

-> ONNX -> TVM

•

TF –

onnx

–

ncnn

四、使用步骤

1.引入库

代码如下:

pip install onnx

pip install onnxruntime

2.读入数据

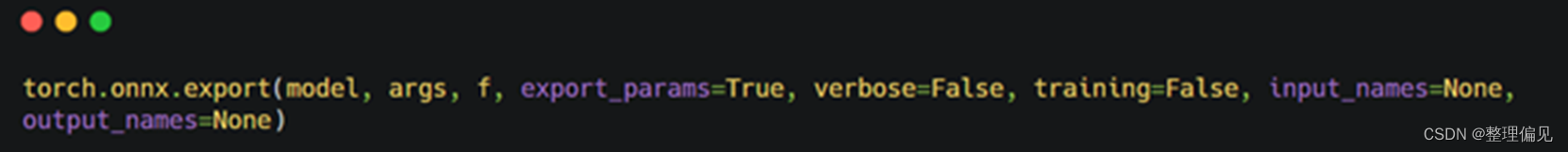

代码如下(示例将pytorch模型导出为ONNX格式):

参数说明:

model(torch.nn.Module) - 要导出的模型

args(参数集)- 模型的输入

f - 类文件对象(必须实现文件描述符的返回)或包含文件名的字符串。二进制 Protobuf 将写入此文件。

export_params (bool, default True) - 如果指定,将导出所有参数。如果只想导出未经训练的模型,请将此参数设置为 False。在这种情况下,导出的模型将首先按照 model.state_dict().values() 指定的顺序将所有参数作为参数。

verbose (bool, default False) - 如果指定,将输出导出跟踪的调试描述。

training (bool, default False) - 在训练模型下导出模型。目前ONNX只是用于推理模型的导出,所以一般不需要设置为True。

input_names(字符串列表,默认为空列表)- 按顺序为图中的输入节点分配名称。

output_names(字符串列表,默认为空列表)- 按顺序为图中的输出节点分配名称。

五

、如何查看onnx网络结构和参数

六

、一个简单例子的实现

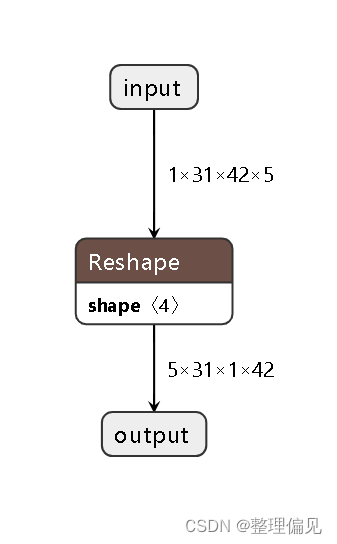

例子介绍:实现一个简单的reshape(确保已经完成库的安装)

import torch

class JustReshape(torch.nn.Module):

def __init__(self):

super(JustReshape, self).__init__()

def forward(self, x):

return x.view((x.shape[3], x.shape[1], x.shape[0], x.shape[2]))

net = JustReshape()

model_name = 'just_reshape.onnx'#保存ONNX的文件名字

dummy_input = torch.randn(1, 31, 42, 5)

torch.onnx.export(net, dummy_input, model_name, input_names=['input'], output_names=['output'])

如上图所示,可以看到在这个例子中,如果我们指定

input_shapes

为:

{'input': [1,31,42,5]}

,那么这个函数的输出也为

{'input': [5,31,1,42]}

。如果不指定,输出就是

{}

。

七

、ONNX 的其他基本操作

1.获取onnx模型的输出层

import onnx

# 加载模型

model = onnx.load('onnx_model.onnx’)

# 检查模型格式是否完整正确

onnx.checker.check_model(model)

# 获取输出层,包括层名、维度信息

output = self.model.graph.output

print(output)

2.获取中间节点的输出数据

import onnx

from onnx import helper

model = onnx.load('onnx_model.onnx’)

# 创建中间节点:层名、数据类型、维度信息

prob_info = helper.make_tensor_value_info('layer1',onnx.TensorProto.FLOAT, [1, 3, 320, 280])

# 将构造好的中间节点插入到模型中

model.graph.output.insert(0, prob_info)

#保存新模型

onnx.save(model, 'onnx_model_new.onnx’)

3.删除指定节点

#item是要删除的节点

model.graph.output.remove(item)

八,技术细节(一些限制的提醒)

ONNX只是一种格式,就像json一样。 只要你满足一定的规则,它就是合法的,所以简单地从 Pytorch 转换成 ONNX 文件是很容易的。 但是不同的后端设备接受的onnx是不一样的,所以运行的时候会出现问题。 Pytorch自带的torch.onnx.export转换的ONNX、ONNXRuntime需要的ONNX和TensorRT需要的ONNX是不一样的。

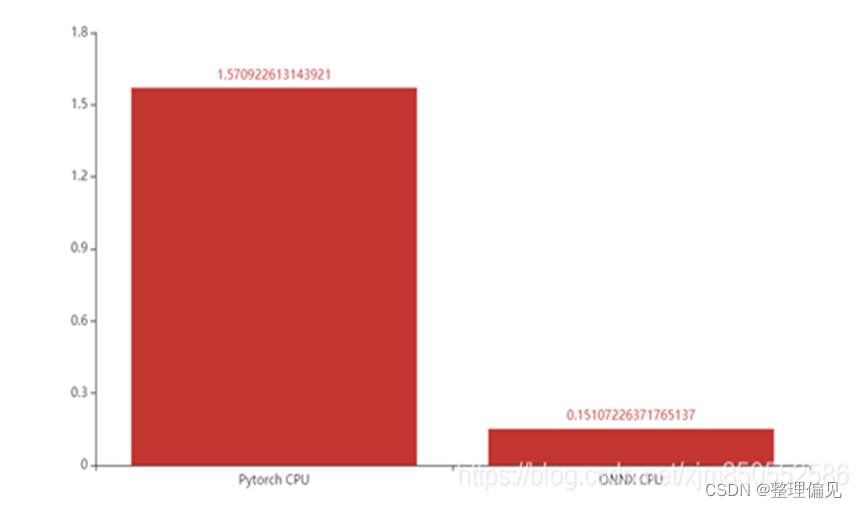

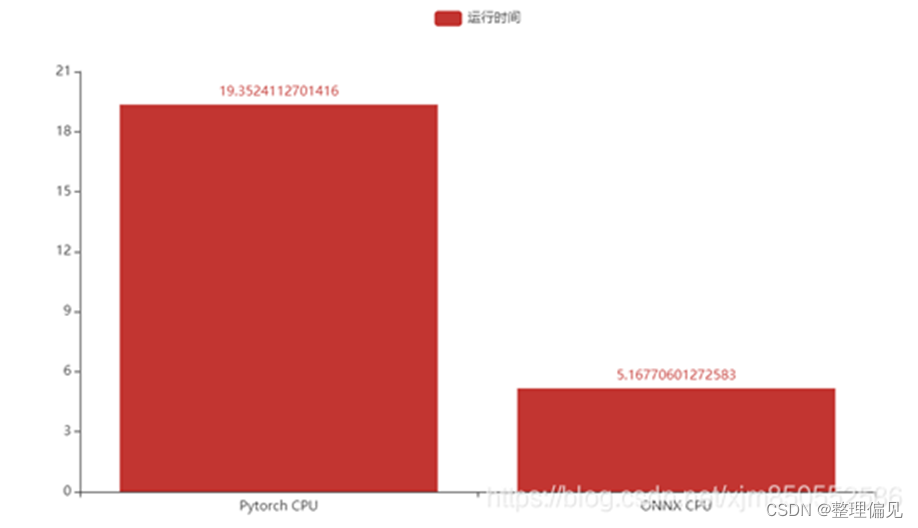

九,推理速度对比

选择基本 CNN 模型并在 MNIST 数据集上进行测试。

其中在pytorch下加载模型需要1.57s,在ONNX中加载模型需要0.15s左右。

在Pytorch下完成整个测试集的推理时间需要19.35s,

而ONNX则需要5.16s,推理速度快了约2.75倍。

想更深入了解对比可以看这个链接:

•

https://github.com/Azure/MachineLearningNotebooks/blob/master/how-to-use-azureml/deployment/onnx/onnx-inference-mnist-deploy.ipynb

十,参考资料