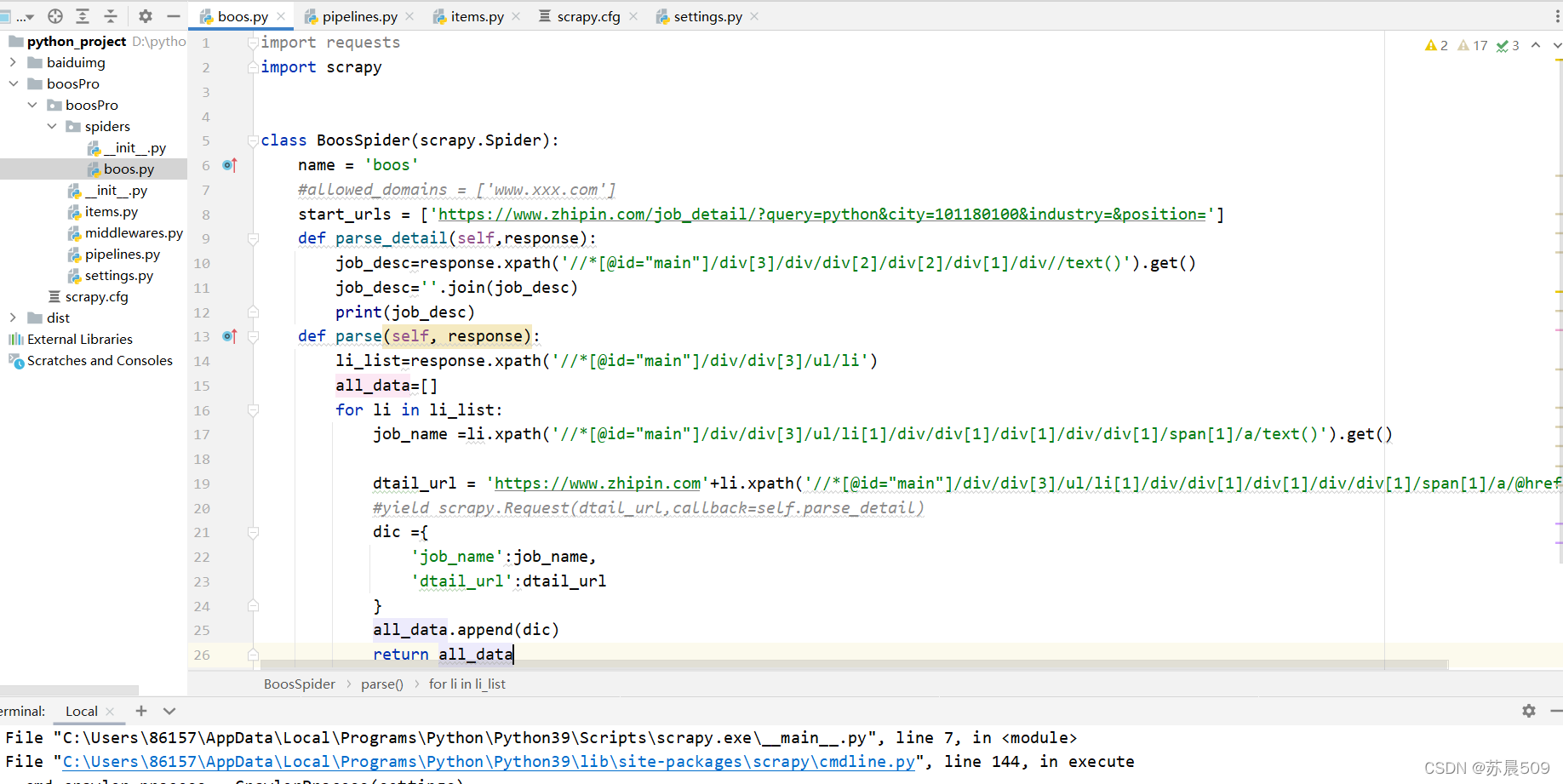

首先是数据分析,分析好了准备存储。

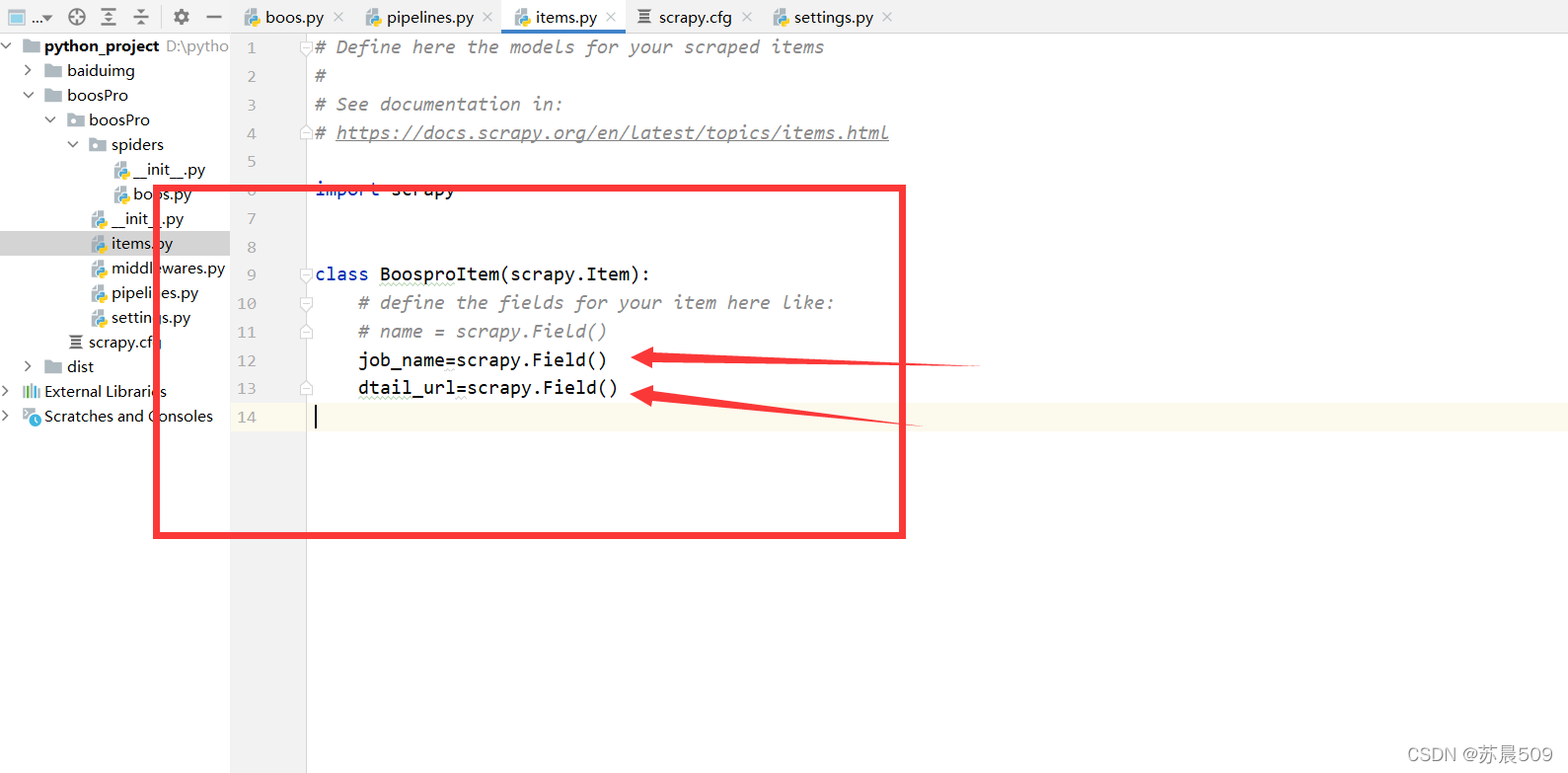

在item中定义相关的属性

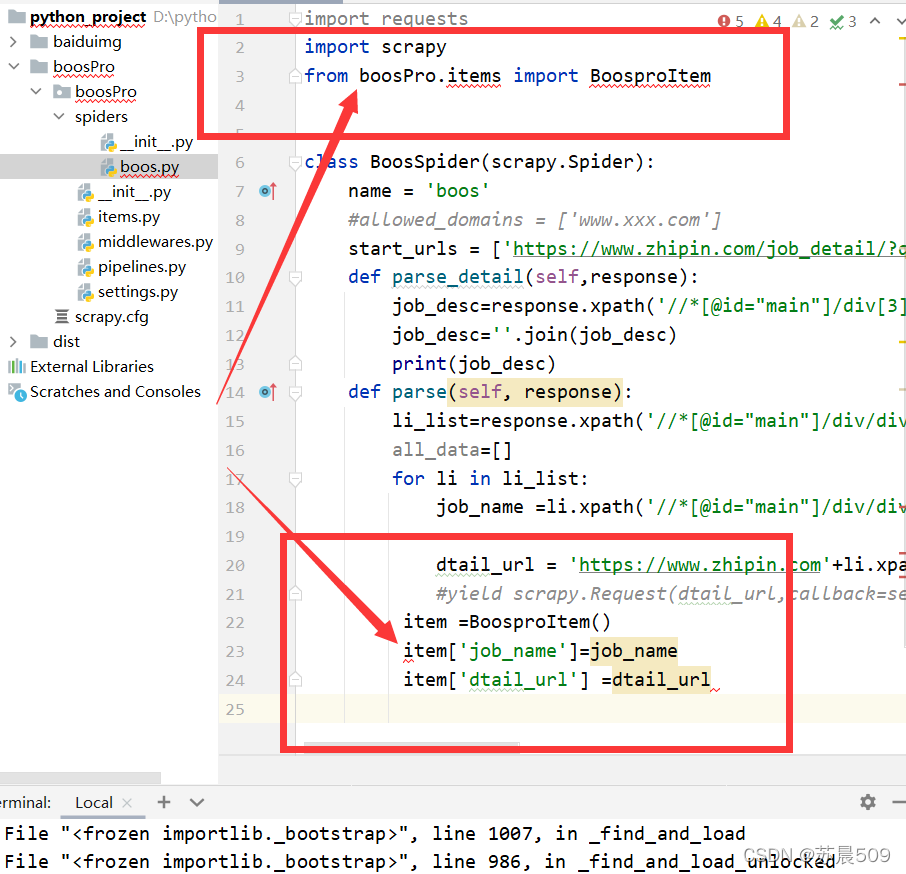

将解析的数据封装储存到item类型对象

这个报错不用管,这样的输入是可以用的

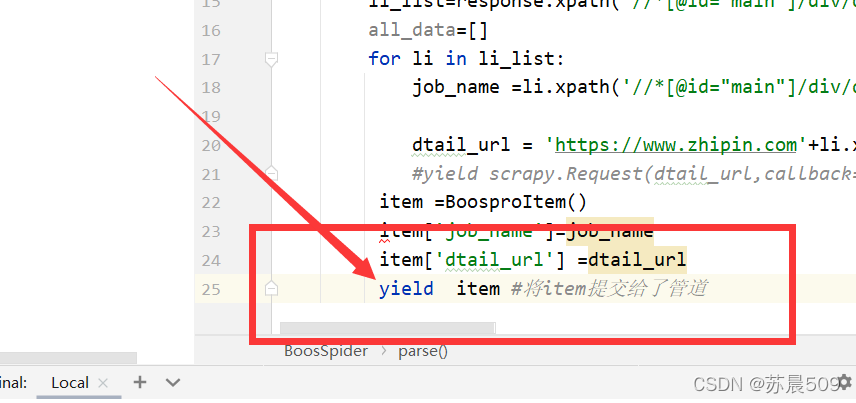

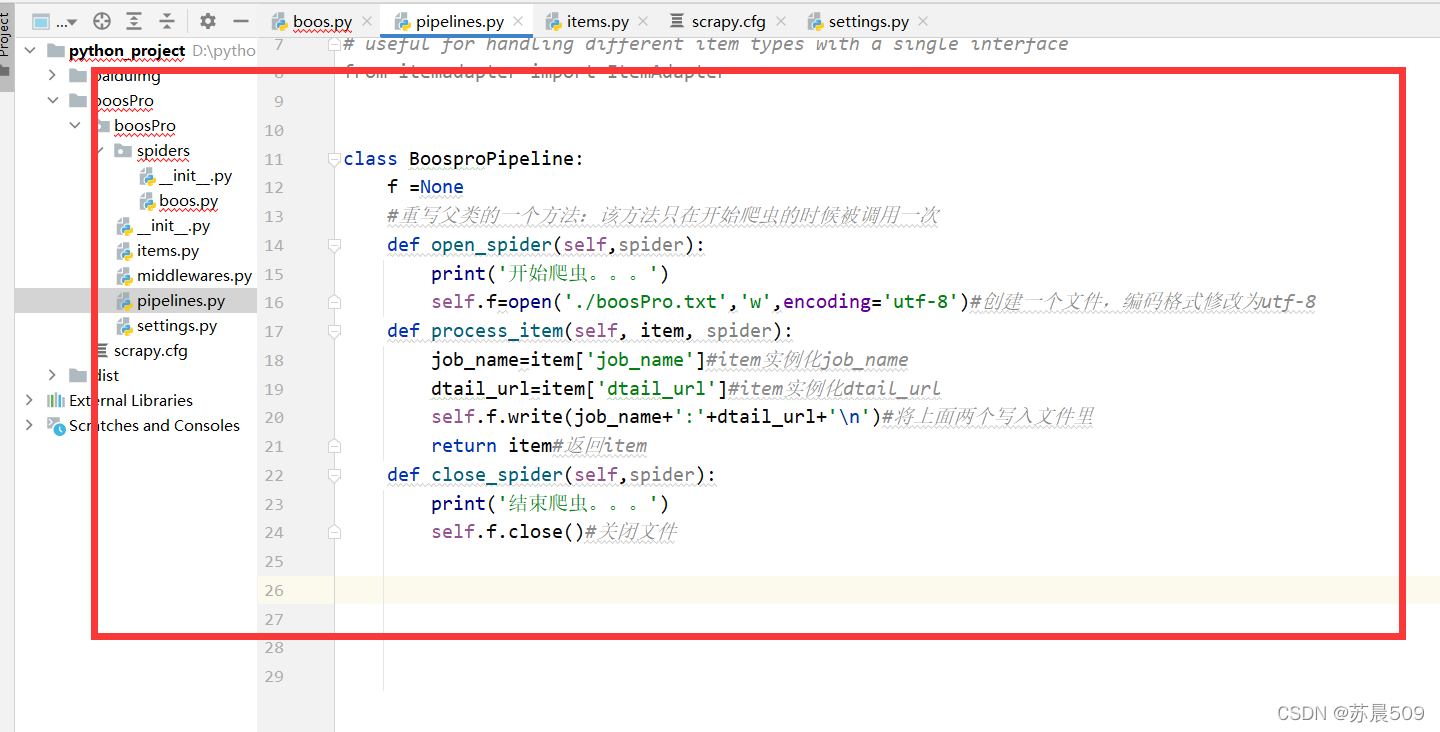

然后将item类型对象提交给管道进行持久化存储操作。

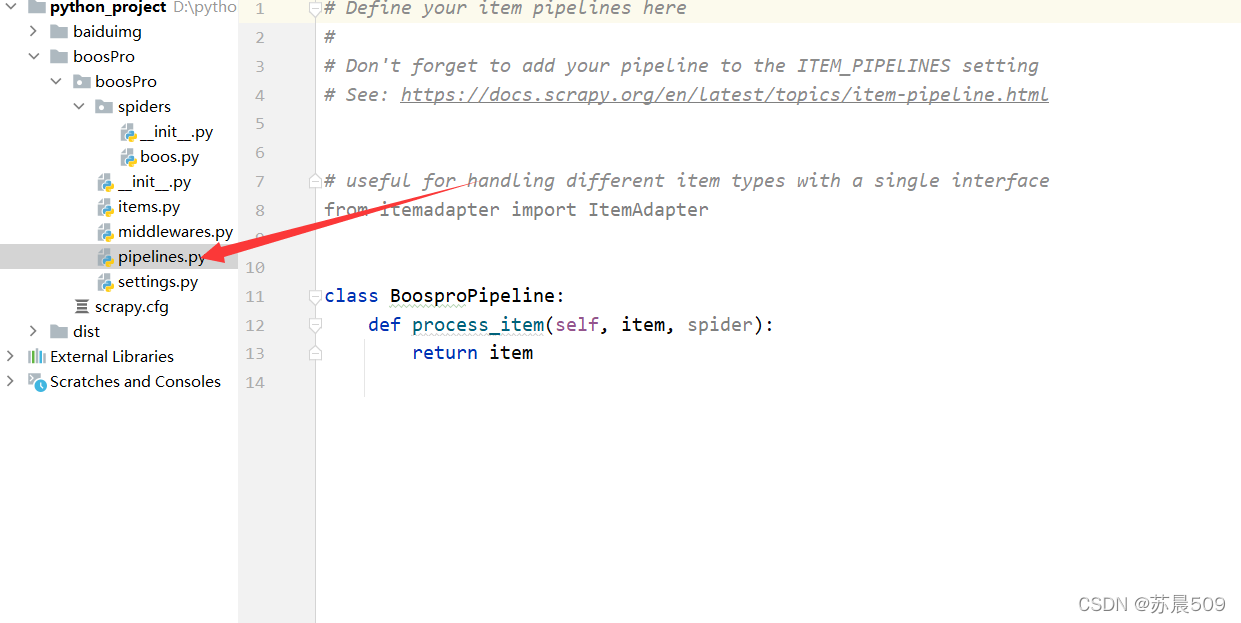

这个是专门用来处理item类型对象的,从爬虫文件提交的item类型对象,会在管道类的process_item接收后,进行持久化存储的操作,该方法每当接收一次就会被调用一次。

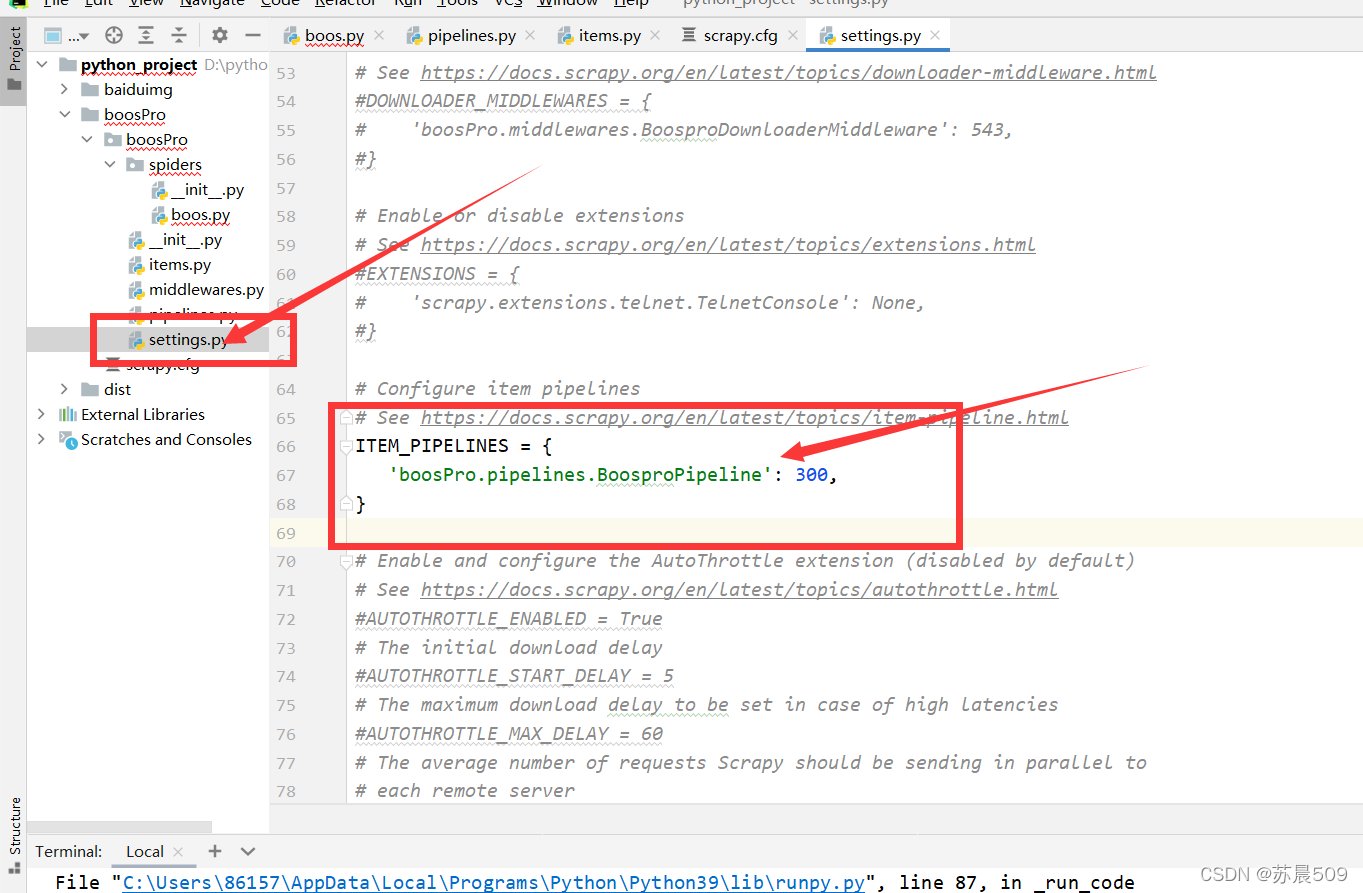

在配置文件中开启管道,激活一下item_piprlines,后面的300优先数字,数字越小优先级就越高

激活以后就可以,运行scrapy crawl 爬虫源文件名称

版权声明:本文为weixin_64700739原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。