Tensorboard可视化神经网络结构@

TOC

Pytorch使用Tensorboard可视化网络结构

1.下载可视化代码

git clone https://github.com/lanpa/tensorboard-pytorch.git

2.安装PyTorch 0.4 +torchvision 0.2

3.安装Tensorflow和Tensorboard:

pip install tensorflow

pip install tensorboard==1.7.0

4.安装可视化工具:

pip install tensorboardX

5.运行下面的测试代码demo_LeNet.py :

import torch

import torch.nn as nn

from tensorboardX import SummaryWriter

from torch.autograd import Variable

class LeNet(nn.Module):

def __init__(self):

super(LeNet, self).__init__()

self.conv1 = nn.Sequential( #input_size=(1*28*28)

nn.Conv2d(1, 6, 5, 1, 2),

nn.ReLU(), #(6*28*28)

nn.MaxPool2d(kernel_size=2, stride=2), #output_size=(6*14*14)

)

self.conv2 = nn.Sequential(

nn.Conv2d(6, 16, 5),

nn.ReLU(), #(16*10*10)

nn.MaxPool2d(2, 2) #output_size=(16*5*5)

)

self.fc1 = nn.Sequential(

nn.Linear(16 * 5 * 5, 120),

nn.ReLU()

)

self.fc2 = nn.Sequential(

nn.Linear(120, 84),

nn.ReLU()

)

self.fc3 = nn.Linear(84, 10)

# 定义前向传播过程,输入为x

def forward(self, x):

x = self.conv1(x)

x = self.conv2(x)

# nn.Linear()的输入输出都是维度为一的值,所以要把多维度的tensor展平成一维

x = x.view(x.size()[0], -1)

x = self.fc1(x)

x = self.fc2(x)

x = self.fc3(x)

return x

dummy_input = Variable(torch.rand(13, 1, 28, 28)) #假设输入13张1*28*28的图片

model = LeNet()

with SummaryWriter(comment='LeNet') as w:

w.add_graph(model, (dummy_input, ))

5.上面的代码运行结束后,会在当前目录生成一个叫run的文件夹,里面存储了可视化所需要的日志信息。用cmd进入到runs文件夹所在的目录中(路劲中不能有中文),然后cmd中输入:

tensorboard --logdir runs

遇到的问题

1.当前目录进入cmd

直接在文件目录上数据cmd,按回车

2.输入tensorboard –logdir runs后报错:

这个问题也有可能是intel的DLL文件造成的。

intel有mkl*.dll在C:\Users\peter\AppData\Local\Continuum\anaconda3\Library\bin目录下,

把这个目录添加到PATH,系统的环境变量里,然后重启终端就可以了(注意替换成自己的目录)。

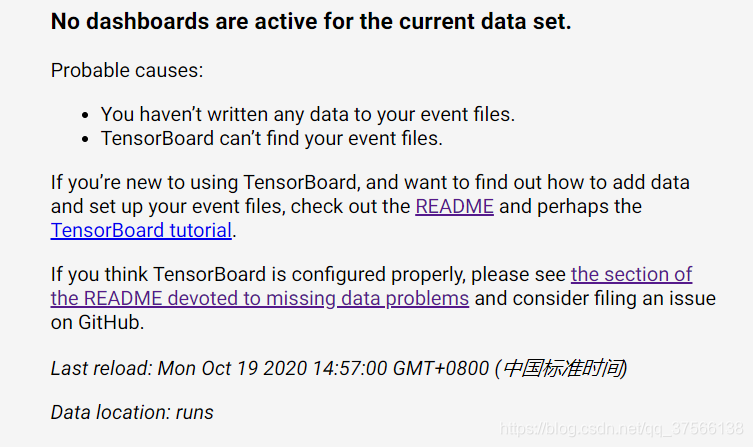

3.点开

链接后,出现:

于是我将

tensorboard --logdir runs

,替换成我生成的数据所对应的文件的目录

tensorboard --logdir=D:\code\untitled\MUPS-master\models\runs\Oct19_14-57-38_DESKTOP-R4HN5A2FeatureExtractor

成功

版权声明:本文为qq_37566138原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。