1 .背景

flume是由cloudera软件公司产出的可分布式日志收集系统,后与2009年被捐赠了apache软件基金会,为hadoop相关组件之一。尤其近几年随着flume的不断被完善以及升级版本的逐一推出,特别是flume-ng;同时flume内部的各种组件不断丰富,用户在开发的过程中使用的便利性得到很大的改善,现已成为apache top项目之一.

2 .概述

1. 什么是flume?

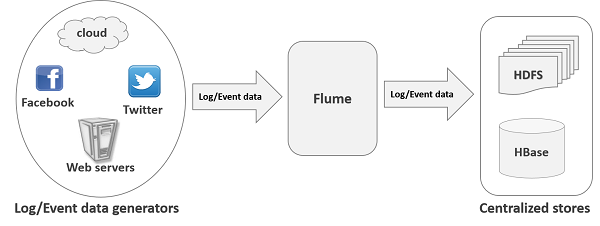

apache Flume 是一个从可以收集例如日志,事件等数据资源,并将这些数量庞大的数据从各项数据资源中集中起来存储的工具/服务,或者数集中机制。flume具有高可用,分布式,配置工具,其设计的原理也是基于将数据流,如日志数据从各种网站服务器上汇集起来存储到HDFS,HBase等集中存储器中。其结构如下图所示:

2.应用场景

比如我们在做一个电子商务网站,然后我们想从消费用户中访问点特定的节点区域来分析消费者的行为或者购买意图. 这样我们就可以更加快速的将他想要的推送到界面上,实现这一点,我们需要将获取到的她访问的页面以及点击的产品数据等日志数据信息收集并移交给Hadoop平台上去分析.而Flume正是帮我们做到这一点。现在流行的内容推送,比如广告定点投放以及新闻私人定制也是基于次,不过不一定是使用FLume,毕竟优秀的产品很多,比如facebook的Scribe,还有Apache新出的另一个明星项目chukwa,还有淘宝Time Tunnel。

3.Flume的优势

1. Flume可以将应用产生的数据存储到任何集中存储器中,比如HDFS,HBase

2. 当收集数据的速度超过将写入数据的时候,也就是当收集信息遇到峰值时,这时候收集的信息非常大,甚至超过了系统的写入数据能力,这时候,Flume会在数据生产者和数据收容器间做出调整,保证其能够在两者之间提供一共平稳的数据.

3. 提供上下文路由特征

4. Flume的管道是基于事务,保证了数据在传送和接收时的一致性.

5. Flume是可靠的,容错性高的,可升级的,易管理的,并且可定制的。

4. Flume具有的特征:

1. Flume可以高效率的将多个网站服务器中收集的日志信息存入HDFS/HBase中

2. 使用Flume,我们可以将从多个服务器中获取的数据迅速的移交给Hadoop中

3. 除了日志信息,Flume同时也可以用来接入收集规模宏大的社交网络节点事件数据,比如facebook,twitter,电商网站如亚马逊,flipkart等

4. 支持各种接入资源数据的类型以及接出数据类型

5. 支持多路径流量,多管道接入流量,多管道接出流量,上下文路由等

6. 可以被水平扩展

3. Flume的结构

1. flume的外部结构:

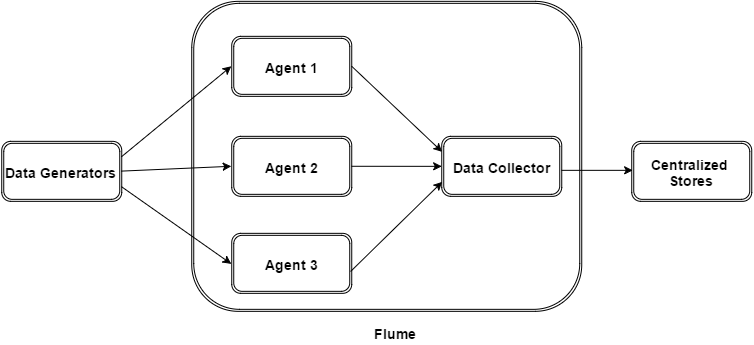

如上图所示,数据发生器(如:facebook,twitter)产生的数据被被单个的运行在数据发生器所在服务器上的agent所收集,之后数据收容器从各个agent上汇集数据并将采集到的数据存入到HDFS或者HBase中

2. Flume 事件

事件作为Flume内部数据传输的最基本单元.它是由一个转载数据的字节数组(该数据组是从数据源接入点传入,并传输给传输器,也就是HDFS/HBase)和一个可选头部构成.

典型的Flume 事件如下面结构所示:

我们在将event在私人定制插件时比如:flume-hbase-sink插件是,获取的就是event然后对其解析,并依据情况做过滤等,然后在传输给HBase或者HDFS.

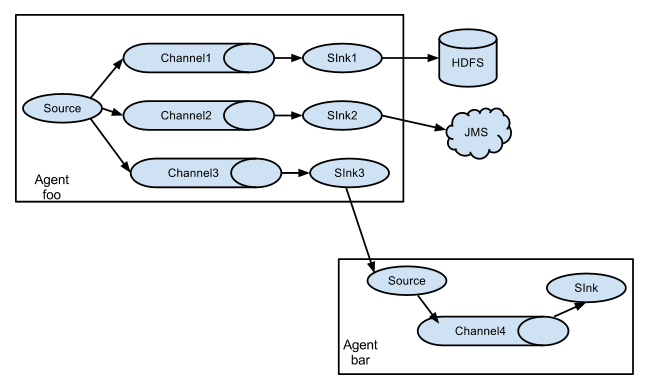

3.Flume Agent

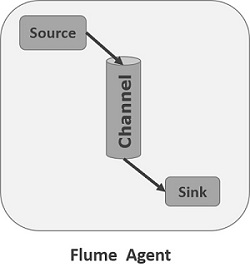

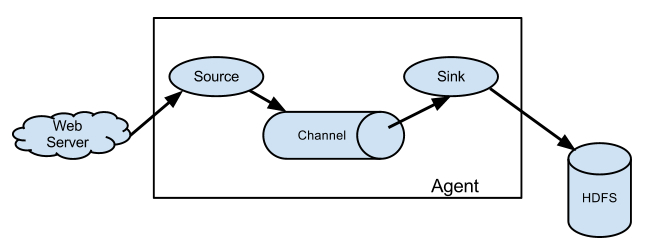

我们在了解了Flume的外部结构之后,知道了Flume内部有一个或者多个Agent,然而对于每一个Agent来说,它就是一共独立的守护进程(JVM),它从客户端哪儿接收收集,或者从其他的 Agent哪儿接收,然后迅速的将获取的数据传给下一个目的节点sink,或者agent. 如下图所示flume的基本模型

Agent主要由:source,channel,sink三个组件组成.

Source:

从数据发生器接收数据,并将接收的数据以Flume的event格式传递给一个或者多个通道channal,Flume提供多种数据接收的方式,比如Avro,Thrift,twitter1%等

Channel:

channal是一种短暂的存储容器,它将从source处接收到的event格式的数据缓存起来,直到它们被sinks消费掉,它在source和sink间起着一共桥梁的作用,channal是一个完整的事务,这一点保证了数据在收发的时候的一致性. 并且它可以和任意数量的source和sink链接. 支持的类型有: JDBC channel , File System channel , Memort channel等.

sink:

sink将数据存储到集中存储器比如Hbase和HDFS,它从channals消费数据(events)并将其传递给目标地. 目标地可能是另一个sink,也可能HDFS,HBase.

它的组合形式举例:

以上介绍的flume的主要组件,下面介绍一下Flume插件:

1. Interceptors拦截器

用于source和channel之间,用来更改或者检查Flume的events数据

2. 管道选择器 channels Selectors

在多管道是被用来选择使用那一条管道来传递数据(events). 管道选择器又分为如下两种:

默认管道选择器: 每一个管道传递的都是相同的events

多路

复用通道选择器: 依据每一个event的头部header的地址选择管道.

3.sink线程

用于激活被选择的sinks群中特定的sink,用于负载均衡.

4.Flume与Kafka对比

-

kafka和flume都是日志系统,

kafka是分布式消息中间件,自带存储,提供push和pull存取数据功能。

flume分为agent(数据采集器),collector(数据简单处理和写入),storage(存储器)三部分,每一部分都是可以定制的。比如agent采用

RPC(Thrift-RPC)、text(文件)等,

storage指定用hdfs做。

-

kafka做日志缓存应该是更为合适的,但是 flume的数据采集部分做的很好,可以定制很多数据源,减少开发量。所以比较流行flume+kafka模式,如果为了利用flume写hdfs的能力,也可以采用kafka+flume的方式。

采集层

主要可以使用

Flume, Kafka

两种技术。

Flume

:

Flume

是管道流方式,提供了很多的默认实现,让用户通过参数部署,及扩展

API.

Kafka

:

Kafka

是一个可持久化的分布式的消息队列。

-

Kafka

是一个非常通用的系统。你可以有许多生产者和很多的消费者共享多个主题

Topics

。相比之下

,Flume

是一个专用工具被设计为旨在往

HDFS,HBase

发送数据。它对

HDFS

有特殊的优化,并且集成了

Hadoop

的安全特性。所以,

Cloudera

建议如果数据被多个系统消费的话,使用

kafka

;如果数据被设计给

Hadoop

使用,使用

Flume

。

-

正如你们所知

Flume

内置很多的

source

和

sink

组件。然而,

Kafka

明显有一个更小的生产消费者生态系统,并且

Kafka

的社区支持不好。希望将来这种情况会得到改善,但是目前:使用

Kafka

意味着你准备好了编写你自己的生产者和消费者代码。如果已经存在的

Flume Sources

和

Sinks

满足你的需求,并且你更喜欢不需要任何开发的系统,请使用

Flume

。

-

Flume

可以使用拦截器实时处理数据。这些对数据屏蔽或者过量是很有用的。

Kafka

需要外部的流处理系统才能做到。

-

Kafka

和

Flume

都是可靠的系统

,

通过适当的配置能保证零数据丢失。然而,

Flume

不支持副本事件。于是,如果

Flume

代理的一个节点崩溃了,即使使用了可靠的文件管道方式,你也将丢失这些事件直到你恢复这些磁盘。如果你需要一个高可靠行的管道,那么使用

Kafka

是个更好的选择。

-

Flume

和

Kafka

可以很好地结合起来使用。如果你的设计需要从

Kafka

到

Hadoop

的流数据,使用

Flume

代理并配置

Kafka

的

Source

读取数据也是可行的:你没有必要实现自己的消费者。你可以直接利用

Flume

与

HDFS

及

HBase

的结合的所有好处。你可以使用

Cloudera Manager

对消费者的监控,并且你甚至可以添加拦截器进行一些流处理。

Flume

和

Kafka

可以结合起来使用。通常会使用

Flume + Kafka

的方式。其实如果为了利用

Flume

已有的写

HDFS

功能,也可以使用

Kafka + Flume

的方式。

—————————————————-<END>——————————————————-