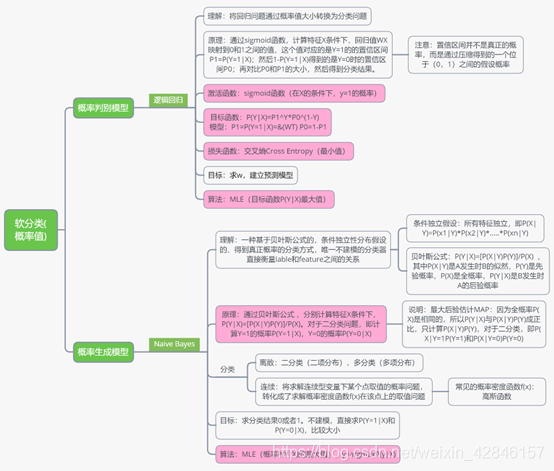

软分类是直接根据概率值进行判断的,求解两种概率P(y=1)和P(y=-1),然后对概率值进行比较,判断所属类别,如下:

注意:虽然逻辑回归得到了概率值,但是它是进行了置信区间的变换,是类概率,并不是真正意义上的概率,只有朴素贝叶斯是真正意义上对应的概率值。

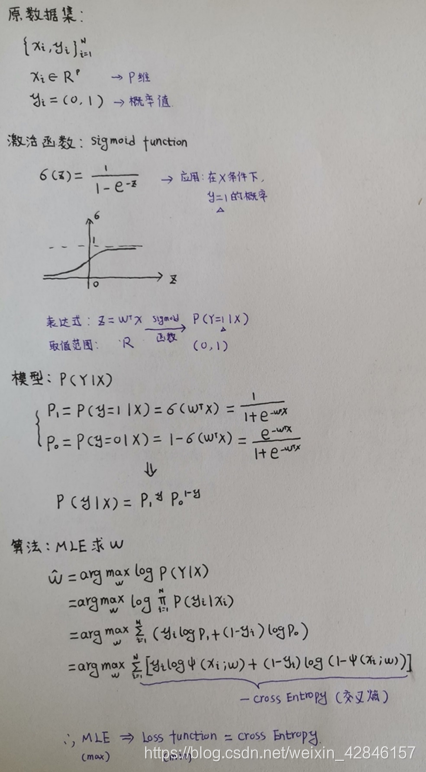

1. 逻辑回归(logistics regression)

-

说明:名字是一种音译,是一种名为“回归”的分类

-

目标:通过sigmoid函数计算P1=P(Y=1|X),然后通过1-

P1计算P0=P(Y=0|X),根据二者进行建模,求得w的值,获取对应的模型。测试的时候,由输入和模型(w)计算得到

P1=P(Y=1|X)和 P0=P(Y=0|X),对二者进行对比,求分类结果。 -

计算方法如下:

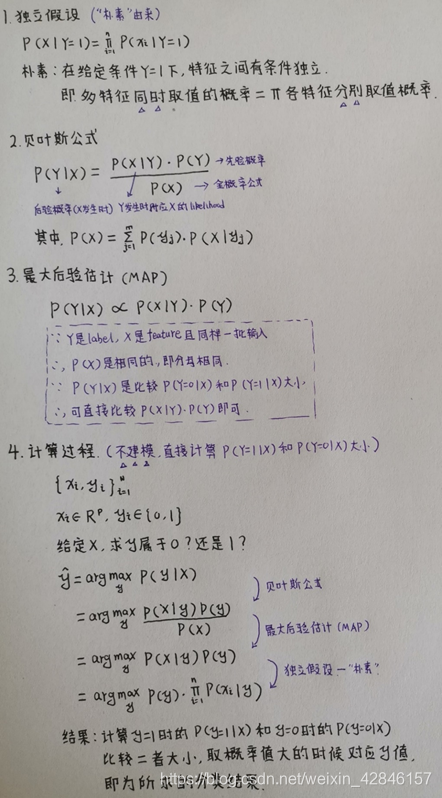

2. 朴素贝叶斯

-

说明:唯一一种求真正概率的分类器,唯一不建模的分类器

-

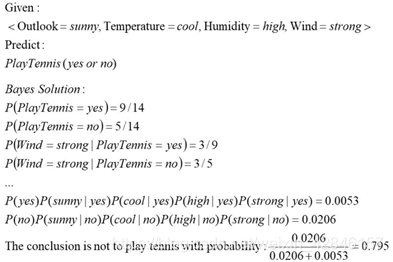

目标:在独立假设的条件下,通过贝叶斯公式,计算P1=P(Y=1|X)和P0=P(Y=0|X),对二者进行对比,求分类结果。

-

计算方法如下:

-

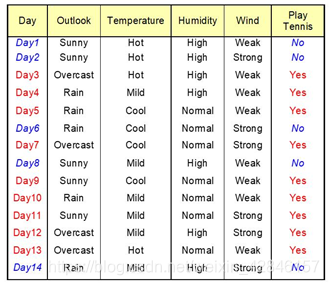

举例:根据天气状况,决定是否去打乒乓球。

说明:在分类器里面,只有朴素贝叶斯得到的是真正的概率,决策树、逻辑回归和SVM都是通过归一化或者sigmoid函数得到的类概率。

参考:

版权声明:本文为weixin_42846157原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。