一、常见的Web集群调度器

Web集群调度器分为软件和硬件

- 软件通常使用LVS、Haproxy、Nginx

- LVS性能最好,但是搭建相对复杂,Nginx的upstream模块支持集群功能,但是集群节点健康检查功能不强,高并发没有Haproxy好

- 硬件一般使用比较多的是F5、绿盟和深信服等

二、Haproxy集群介绍

LVS在企业中抗负载能力很强,但存在不足。

LVS不支持正则处理,不能实现动静分离,对于大型网站,LVS的实施配置复杂,维护成本相对较高

Haproxy是一款可提高可用性、负载均衡、基于TCP和HTTP应用的代理的软件,适合于负载大的Web站点,运行在硬件上可支持数以万计的并发连接请求。

1.Haproxy的特性

1、可靠性和稳定性非常好,可以与硬件级的F5负载均衡器设备相媲美

2、最高可以同时维护4万-5万个并发连接,单位时间内处理的最大请求数为2万个,最大处理能力可达10Git/t

3、支持多达8种负载均衡算法,同时也支持会话保持

4、支持连接拒绝、全透明代理等独特功能

5、支持虚拟主机功能、从而实现Web负载均衡更加灵活

6、拥有强大的ACL支持,用于控制访问

7、其独特的弹性二叉树数据结构,使数据结构的复杂性上升到了0(1),即数据的查询速度不会随着数据条目的增加而速度有所下降

8、支持客户端的Keepalived功能,减少客户端与Haproxy的多次三次握手导致资源浪费,让多个请求在一次TCP连接中完成

9、支持TCP加速,零复制功能,类似于mmap机制

10、支持响应池(response buffering)

11、支持RDP协议

12、基于源的粘性,类似于Nginx的ip_hash功能,把来自同一客户端的请求在一定时间内始终调度到上游的同一服务器

13、更好统计数据接口,其Web接口显示后端翼全中各个服务器的接受、发送、拒绝、错误等数据的统计信息

14、详细的健康状态检测,Web接口中有关对上流服务器的健康检测状态,并提供了一定的管理功能

15、基于流量的健康评估机制

16、基于http认证

17、基于命令行的管理接口

18、日志分析器,可对日志进行分析

2.Haproxy常用的调度算法

Haproxy支持多种调度算法,最常用的有8种

2.1轮询调度(Round Robin)

RR算法是最简单最常用的一种算法,轮询分配访问请求实现负载均衡效果

2.2最小连接数(Least Connections)

最小连接数算法,根据后端的节点连接数大小动态分配前端请求,此算法相比较RR算法有很大改进,是用到比较多的一种算法

2.3基于来源访问调度算法(Source Hashing)

- 用于一些有Session会话记录在服务器端的场景,可基于来源的IP、Cookie等做集群调度

- 举例:当服务器有三个节点,当第一个用户访问到节点A,第二个用户访问到节点B。如果第一个用户再次访问时,还是会被指派到节点A,第二个用户也会被指派搭配B,只要负载均衡器不重启,就会一直这样分配。

- 此调度算法的好处就是实现会话保持,但某些IP访问量非常大时,会引起负载均衡不均匀,部分节点访问量大,影响业务使用。

2.4 URi

表示根据请求的URI,做cdn需使用

2.5 url_param

表示根据HTTP请求头来锁定每一次HTTP请求

2.6 rdp-cookie(name)

表示根据cookie(name)来锁定并哈希每一次TCP请求

2.7 source

表示根据请求的源IP,类似Nginx的IP hash机制

2.8 static -rr

表示根据权重,轮询分配

3.nginx和LVS和Haproxy有什么区别

3.1LVS

- 基于第三方应用实现的软负载均衡

- 只能实现4层的IP负载均衡技术,状态监测功能单一,但整体负载均衡性能最强

3.2Nginx

- 基于第三方应用实现的软负载均衡

- 可以实现4层和7层技术

- 主要用于Web服务器或缓存服务器,nginx的upstrean模块虽然也支持群集功能,但是对群集节点健康检查功能不强,性能没有Haproxy好

3.3Haproxy

- 基于linux操作系统内核实现软负载均衡

- 可以提供TCP和HTTP应用的负载均衡综合解决方案

- 在状态监测方面功能更丰富、更强大,可支持端口、URL、脚本等多种状态监测方式

总结

从三个方面来概述,①基于系统内核还是第三方应用,②工作在4层还是7层,③监测状态

- LVS基于操作系统内核实现软负载均衡、nginx和haproxy都是基于第三方应用实现

- LVS可实现4层ip负载均衡技术,4层中LVS负载均衡最轻,nginx和haproxy都可以实现4层和7层

- LVS状态监测功能单一,Haproxy状态监测方面功能强大,可支持,端口、URL、脚本状态监测,nginx主要是web服务器或缓存服务器,虽然也有uostream模块支持群集功能,但是对节点的健康检查不强

三、Haproxy搭建Web集群

1.实验准备

Haproxy服务器:192.168.226.130

Nginx1服务器:192.168.226.131

Nginx2服务器:192.168.226.132

2.Haproxy服务器部署(192.168.226.130)

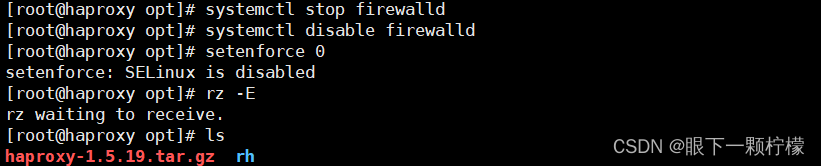

2.1关闭防火墙、关闭核心防护,将Haproxy所需软件包拖到/opt目录下

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

2.2安装所需依赖包

yum -y install pcre-devel zlib-devel gcc gcc-c++ make

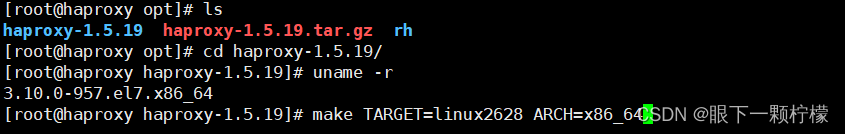

2.3解压软件包,并编译安装Haproxy

tar zxvf haproxy-1.5.19.tar.gz #解压安装包

cd haproxy-1.5.19/ #进入到解压后的目录

uname -r #查看内核版本

make TARGET=linux2628 ARCH=x86_64 #进行编译

TARGET=linux2628 表示内核版本,使用uname -r查看内核,如:2.6.18-371.el5,此时该参数用TARGET=linux26;kernel大于2.6.28的用TARGET=linux2628)

(ARCH=x86_64 系统位数,现在基本都是64位)

make install #安装

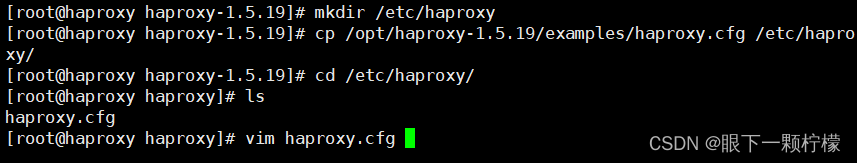

2.4Haproxy服务配置文件修改

mkdir /etc/haproxy

cp /opt/haproxy-1.5.19/examples/haproxy.cfg /etc/haproxy/

cd /etc/haproxy/

vim haproxy.cfg

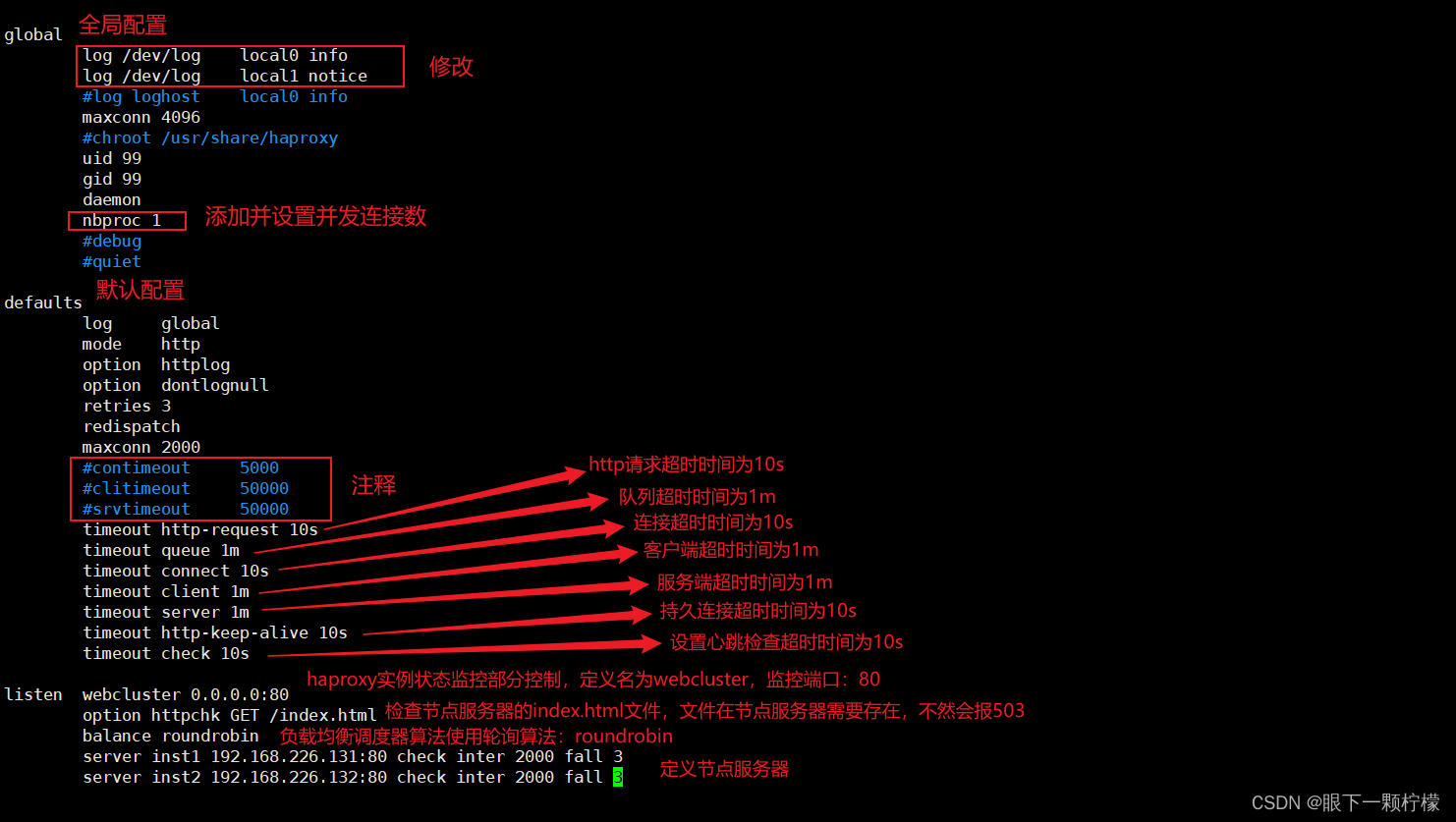

global #全局配置,主要用于定义全局参数,属于进程级的配置,通常和操作系统配置有关

--4~5行--修改,定义haproxy日志输出设置和日志级别,local0为日志设备,默认存放到系统日志

log /dev/log local0 info #修改

log /dev/log local0 notice #修改

#log loghost local0 info

maxconn 4096 #最大连接数,需考虑ulimit -n限制,推荐使用10240

--8行--注释,chroot运行路径,为该服务自设置的根目录,一般需将此行注释掉

#chroot /usr/share/haproxy

uid 99 #用户UID

gid 99 #用户GID

daemon #守护进程模式

nbproc 1 #添加,设置并发进程数,建议与当前服务器CPU核数相等或为其2倍

defaults #配置默认参数,这些参数可以被用到Listen,frontend,backend组件

log global #引入global定义的日志格式

mode http #模式为http(7层代理http,4层代理tcp)

option httplog #日志类别为http日志格式

option dontlognull #不记录健康检查日志信息

retries 3 #检查节点服务器失败次数,连续达到三次失败,则认为节点不可用

redispatch #当服务器负载很高时,自动结束当前队列处理比较久的连接

maxconn 2000 #最大连接数,“defaults”中的值不能超过“global”段中的定义

#contimeout 5000 #设置连接超时时间,默认单位是毫秒

#clitimeout 50000 #设置客户端超时时间,默认单位是毫秒

#srvtimeout 50000 #设置服务器超时时间,默认单位是毫秒

timeout http-request 10s #默认http请求超时时间

timeout queue 1m #默认队列超时时间

timeout connect 10s #默认连接超时时间,新版本中替代contimeout,该参数向后兼容

timeout client 1m #默认客户端超时时间,新版本中替代clitimeout,该参数向后兼容

timeout server 1m #默认服务器超时时间,新版本中替代srvtimeout,该参数向后兼容

timeout http-keep-alive 10s #默认持久连接超时时间

timeout check 10s #设置心跳检查超时时间

--删除下面所有listen项--,添加

listen webcluster 0.0.0.0:80 #haproxy实例状态监控部分配置,定义一个名为webcluster的应用

option httpchk GET /index.html #检查服务器的index.html文件

balance roundrobin #负载均衡调度算法使用轮询算法roundrobin

server inst1 192.168.226.131:80 check inter 2000 fall 3 #定义在线节点

server inst2 192.168.226.132:80 check inter 2000 fall 3

---------------------参数说明-----------------------------------------------------------------

balance roundrobin #负载均衡调度算法

#轮询算法:roundrobin;最小连接数算法:leastconn;来源访问调度算法:source,类似于nginx的ip_hash

check inter 2000 #表示启用对此后端服务器执行健康检查,设置健康状态检查的时间间隔,单位为毫秒

fall 3 #表示连续三次检测不到心跳频率则认为该节点失效

若节点配置后带有“backup”表示该节点只是个备份节点,仅在所有在线节点都失效该节点才启用。不携带“backup”,表示为主节点,和其它在线节点共同提供服务。

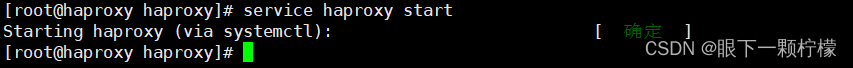

2.5添加haproxy系统服务

cp /opt/haproxy-1.5.19/examples/haproxy.init /etc/init.d/haproxy

chmod +x /etc/init.d/haproxy

chkconfig --add /etc/init.d/haproxy

ln -s /usr/local/sbin/haproxy /usr/sbin/haproxy

service haproxy start 或 /etc/init.d/haproxy start

3.Nginx服务配置(192.168.226.131、192.168.226.132)

3.1关闭防火墙及核心防护

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

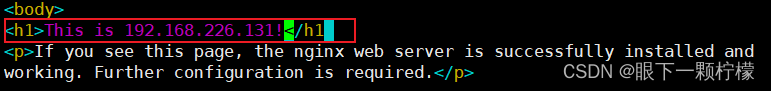

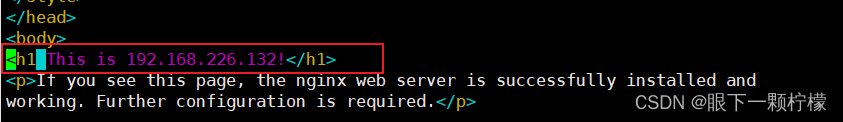

3.2修改index.html文件

因为我们在haproxy配置中指向的是index.html文件,修改此文件,添加内容便于测试

Nginx1

vim /usr/local/nginx/html/index.html

Nginx2

vim /usr/local/nginx/html/index.html

3.3重启服务,测试网页

systemctl restart nginx

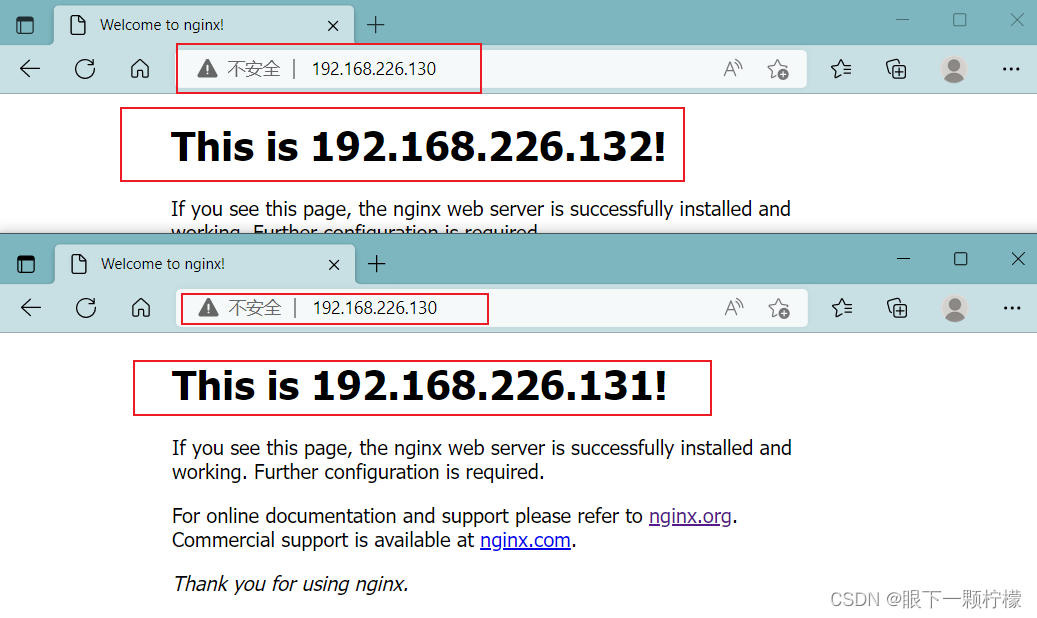

4.Haproxy验证

访问192.168.100.130验证

总结