对抗攻击的防御模型显著增长,但缺乏实用的评估方法阻碍了进展。评估可以定义为:

在给定迭代次数和测试数据集的情况下寻找防御模型的鲁棒性下限

。一种使用的评估方法应该是方便的(即

无参数

的)、高效的(更

少的迭代

)、可靠的(接近

稳健性的下限

),针对这个目标,我们提出了一种

无参数自适应自动攻击(

)

。自适应自动攻击由自

适应方向初始化(ADI )

和

在线统计丢弃策略(OSD)

组成。ADI策略可以

加快评估速度

,DSD可以

自动识别和丢弃难以攻击的图像

。

方法:

预先知识:

c-class分类器f,

模型预测

被计算为:

![]()

本文主要考虑

无目标

攻击,

约束优化

问题定义为:

![]()

PGD在迭代

t次

时的梯度为:

![]()

起点

:

![]()

PGD 通过迭代生成对抗样本:

![]()

为了进一步提高起点多样性,ODI通过

最大化输出空间

的变化来寻找起点,从均匀分布

中抽样随机多样化方向

。

首先计算归一化扰动向量:

![]()

通过以下迭代更新使输出变化最大来生成起始点:

次迭代之后,即初始化迭代次数,ODI获得起点:

![]()

动机:

尽管使用了大量的迭代,但是大多数现有方法通常高估了鲁棒性,这有两个潜在的原因:

-

尽管为攻击生成不同的起始点是有效的,但

随机抽样是次优

的,因为它与模型无关。利用随机抽样产生起始点将

减慢稳健性评估的速度

-

广泛采用的自然迭代策略,即为所有测试样本

分配相同的迭代次数

,是不合理的。而且,天真的迭代策略会付出不必要的努力来干扰难以攻击的图像。

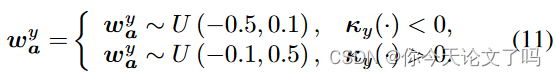

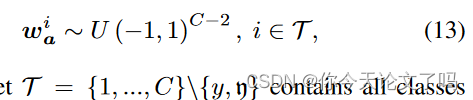

Adaptive Direction Initialization(ADI)

自适应方向初始化来生成比随机抽样更好的方法来初始化攻击,ADI有两个步骤:

useful directions observer step(有用方向观测器)

ADI首先采用随机抽样产生多样化方向

然后ADI使用等式(8)获得的起点来初始化PGD攻击,并且使用PGD攻击获得对抗样本

adaptive directions generation(自适应方向生成)

ADI采用W中求和

的符号作为先验知识来生成自适应方向

:

![]()

是生成的

的先验知识,即

的第c维。

ADI将

的第y个分量生成为:

为了改善

的有效性,ADI随机选择一个标签

,以跟随

的符号

设置

,自适应方向

的其余尺寸,ADI将其计算为:

Online Statistics-based Discarding Strategy(OSD)

鉴于迭代次数接近鲁棒性下限,本文提出了一种新的迭代策略—-

基于在线统计丢弃策略OSD

OSD采用

损失值

来区分难攻击图像和易攻击图像,OSD首先按照每次

重新启动开始时的相应损失值

按

降序

对测试图像进行排序,然后

丢弃

难以攻击的图像,即停止具有

较小损失值

的扰动图像。特别是,给定初始丢弃率

和丢弃增量

,第r次重新启动时的丢弃率公式如下:

![]()

对于其余的图像,OSD为它们

分配相同的迭代次数

,也就是说,为了进一步提高攻击成功率,OSD在重新启动r时要比之前的重新启动时为剩余图像分配更多迭代。具体来说,给定攻击的初始迭代次数

和迭代增量

,第r次重新启动时攻击的迭代次数计算为:

![]()

与自然迭代策略相比,OSD通过自动识别和放弃难以攻击的图像,充分利用了迭代的预算次数。此外,通过在不同重启时为攻击分配不同次数的迭代,OSD有助于进一步接近对抗性鲁棒性的下限。

Adaptive Auto Attack

将自适应方向初始化策略与在线统计丢弃策略结合起来,就形成了自适应自动攻击策略,这个策略有以下优点:

- 是方便的,不需要对每个新的防御模型的参数进行微调

- 是有效的,该策略为每个模型生成自适应方向,并提供更好的起点以加快评估

- 是可靠的,通过在线丢弃难以攻击的图像并适应调整以攻击迭代次数,充分利用了预算迭代次数,进一步接近对抗鲁棒性的下限。