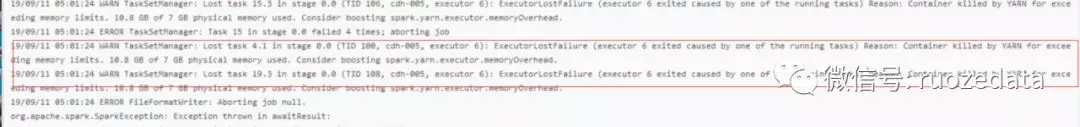

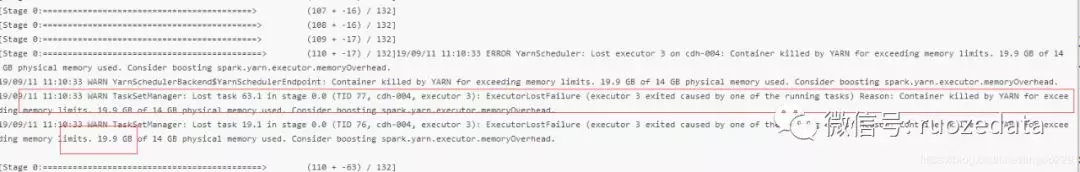

一、问题现象:使用spark sql调用get_json_object函数后,报如下错误:yarn 容器被kill,导致任务失败,查看日志:Container killed by YARN for exceeding memory limits

使用spark命令:

/opt/software/spark-2.2.0-bin-hadoop2.6/bin/spark-sql \

--master yarn-client \

--driver-memory 2G \

--driver-cores 2 \

--num-executors 4 \

--executor-cores 4 \

--executor-memory 6G \

......

二、问题分析过程:

2.1 既然executor内存不够,那么最先想到的就是增大executor-memory内存大小,从6G增大到12G =》通过多次测试发现,有时任务能成功,有时还是报相同的错误,并且内存还越用越多,诡异。

2.2 分析数据量发现其实并不大,也就几十万。以前上千万的数据量都不需要这么多内存。因此怀疑是get_json_object函数引起的问题。

2.3 去掉get_json_object函数,果然任务非常流畅,而且内存调回6G依然是成功的。

2.4 突然灵光一闪,依稀记得线下班讲过这块code,spark.yarn.executor.memoryOverhead这个参数是spark excutor的堆外内存,用于 VM overheads, interned strings, other native overheads, etc。猜想get_json_object应该主要是用的堆外内存。

2.5 spark.yarn.executor.memoryOverhead默认等于max(executorMemory * 0.10,384M),那么增大executorMemory再多,堆外内存实际增加的也比较少,因此考虑直接增大spark.yarn.executor.memoryOverhead值。

2.6 设置spark.yarn.executor.memoryOverhead等于6G,executor-memory减少到4G,经过测试,任务非常稳定的成功。

三、问题结论及终极解决方案:

3.1 原因分析:

该问题是由于get_json_object使用的是堆外内存,默认堆外内存只有max( executorMemory * 0.10,384M),可根据Container killed by YARN for exceeding memory limits. 19.9 GB of 14 GB physical memory used,这里的19.9G估算出堆外内存实际需要19.9G*0.1约等于1.99G,因此最少应该设置spark.yarn.executor.memoryOverhead为2G,为保险起见,我最后设置成了4G,脚本如下:

/opt/software/spark-2.2.0-bin-hadoop2.6/bin/spark-sql \

--master yarn-client \

--driver-memory 2G \

--driver-cores 2 \

--num-executors 4 \

--executor-cores 4 \

--executor-memory 4G \

--conf "spark.yarn.executor.memoryOverhead=4G" \

......

3.2 本案例的Container killed by YARN for exceeding memory limits的解决方案:

3.2.1 增大executor-memory内存大小

3.2.2 增大

spark.yarn.executor.memoryOverhead内存大小

具体选用那一种,效果更好,需要结合具体场景,所以千万不要忽略堆外内存哟。

转自微信公众号